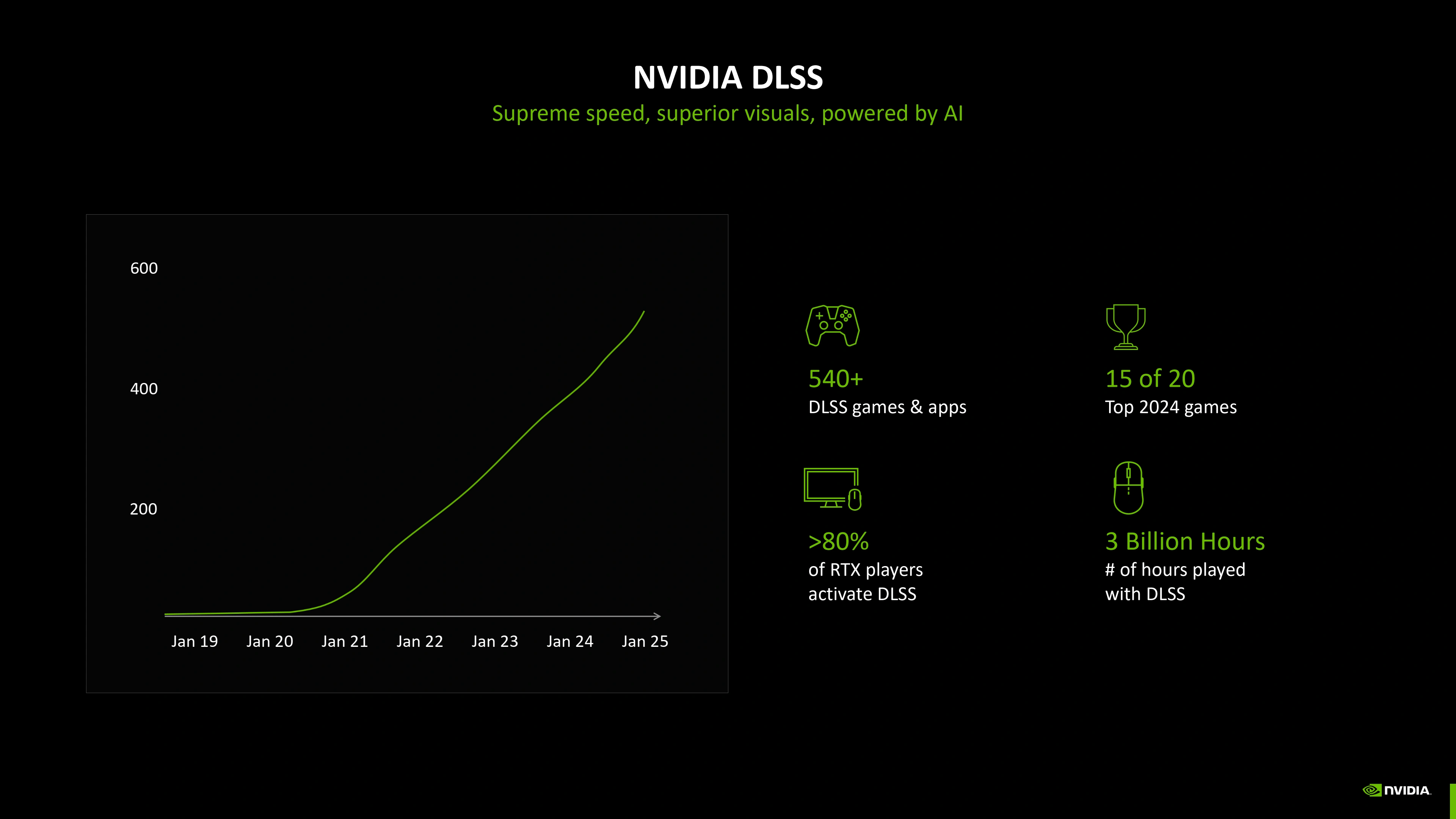

L'évolution du DLSS

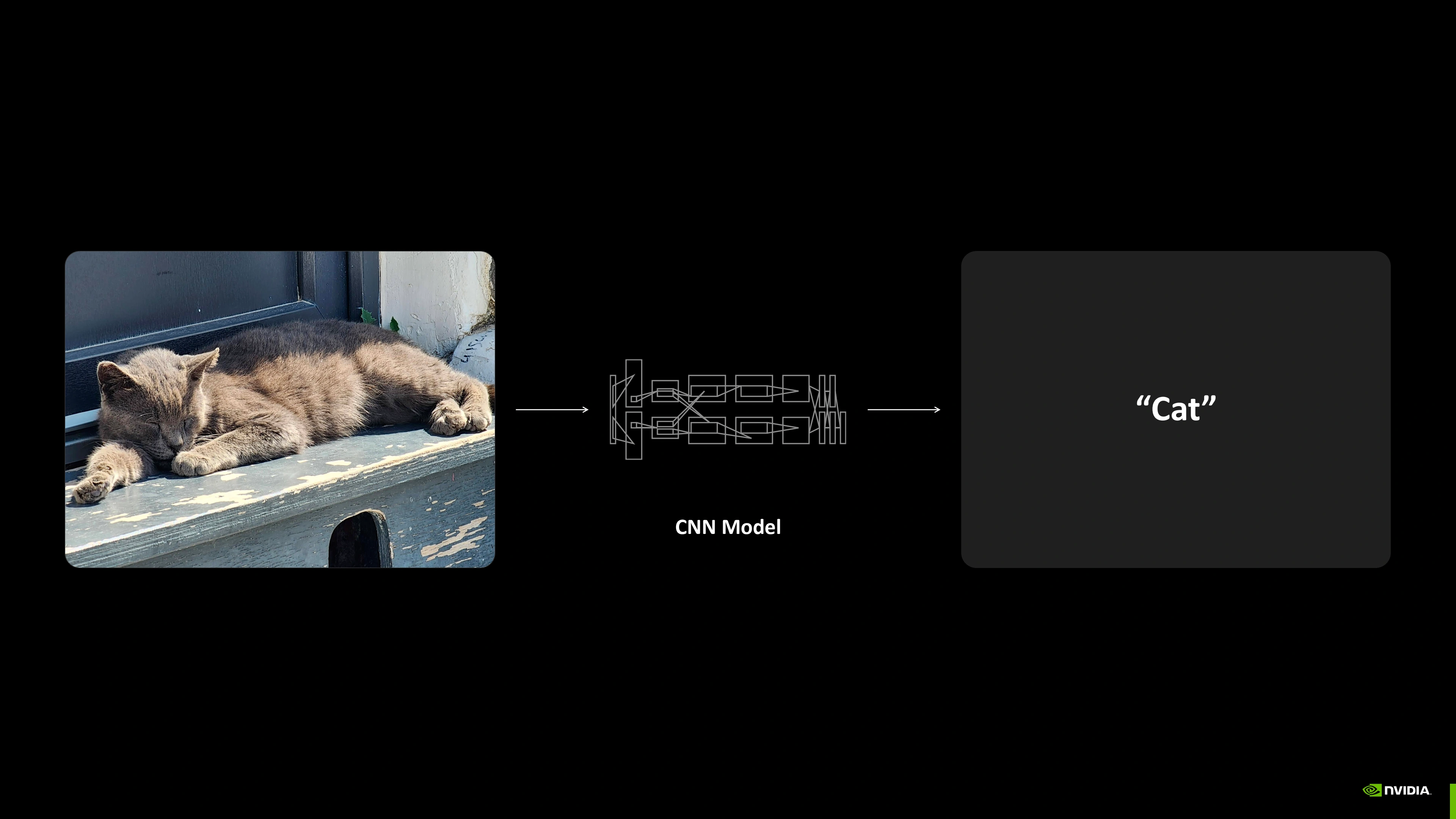

Avant de parler de la dernière itération du Deep Learning Super Sampling aka DLSS, rappelons ce qu'est cette technologie de Nvidia dont l'origine remonte à l'intronisation de Turing (RTX 20). La promesse du DLSS (1) était d'offrir des performances en nette hausse, pour une qualité visuelle équivalente à celle atteinte avec un TAA classique. Pour ce faire, le caméléon procèdait au rendu de dizaines de milliers d'images avec une excellente qualité visuelle à partir d'une build du jeu mis à disposition par les développeurs, collectant ainsi le résultat de sortie et les données d'entrée brutes (images en basse résolution et aliasées). Tout ceci était ensuite utilisé lors d'opérations d'apprentissage profond (Deep Learning) : des réseaux de neurones artificiels (de type auto-encodeur convolutif) étaient entraînés à obtenir cette qualité de sortie avec ces données d'entrée, au moyen de méthodes fortement matheuses (back propagation), leurs permettant "d'apprendre" les spécificités propres à ces images.

Il résultait de ces apprentissages des DNN model (Deep Neural Network signifie "réseau de neurones profond") capables d'imiter le comportement observé sur l'échantillon utilisé lors de l'apprentissage, et ce pour un coût bien moindre que la technique originelle. Comment ? Par le biais des Tensor Cores, qui utilisent alors les DNN model sur l'image brute aliasée de définition plus faible, pour inférer en temps réel le rendu anti-aliasé à la définition d'affichage requise. L'inférence est friande des calculs en faible précision où les Tensor Cores excellent. Le résultat bien qu'encourageant restait néanmoins largement perfectible, ce à quoi Nvidia s'attela avec la version 2 ayant revu en profondeur l'auto-encodeur convolutif (commun à présent à tous les jeux), mais ce n'est pas tout, puisque la technique de Temporal Feedback a été ajoutée. Il s'agit en fait de l'intégration des vecteurs de mouvement aux données d'entrée collectées en basse résolution. Ceux-ci sont ensuite appliqués à la précédente image de sortie (haute qualité), afin d'estimer plus précisément quelle sera l'apparence de la suivante. Cela permet de rendre des images plus nettes en améliorant la stabilité d'une image à la suivante. Nvidia a ensuite poursuivi l'amélioration de son modèle par apprentissage, au fur à mesure de la sortie de nouveaux jeux et la collecte de nouveaux artefacts à corriger.

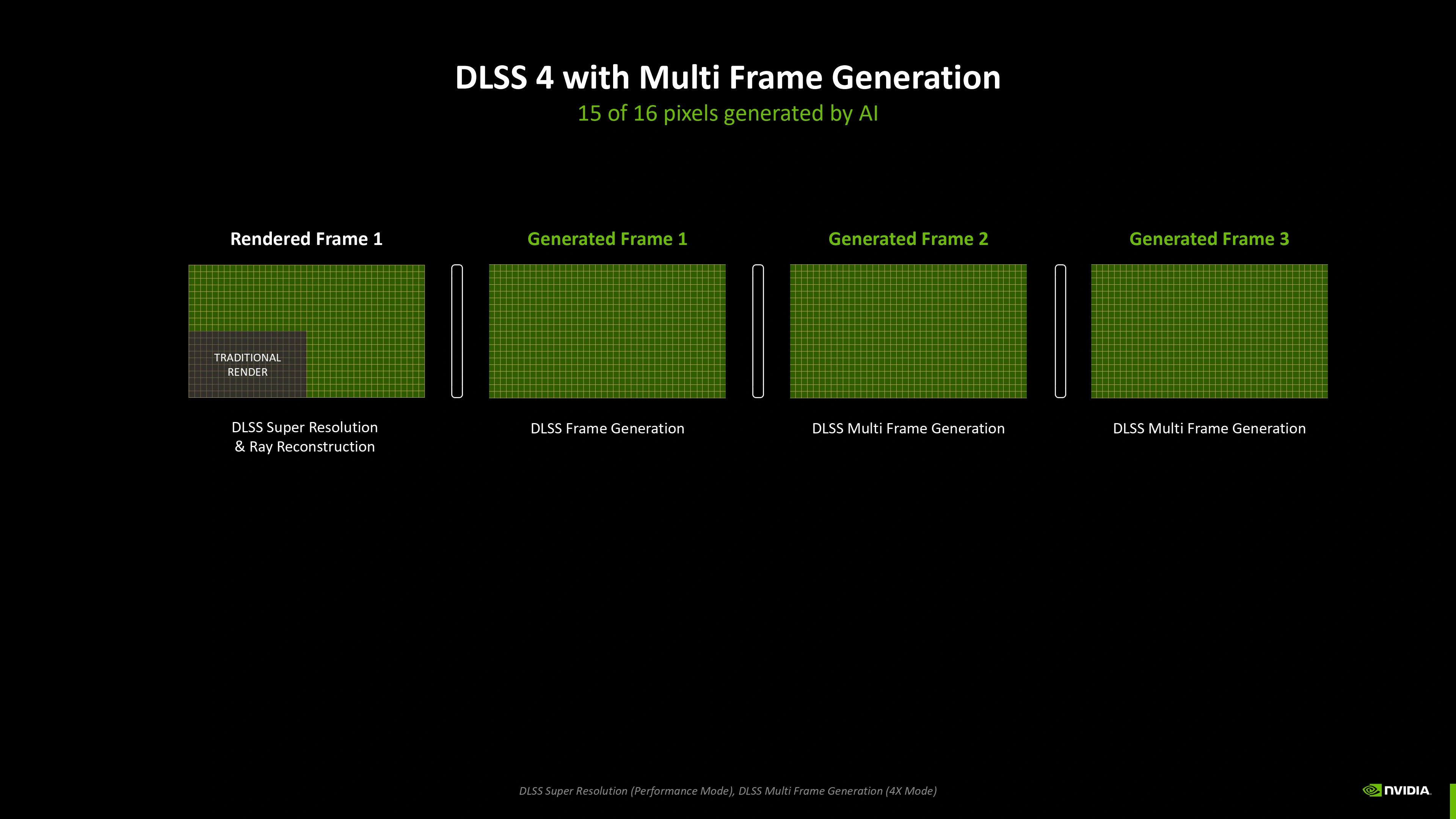

Pour le DLSS 3, les verts ont ajouté une nouvelle technologie s'additionnant à l'upscaler : la génération d'image. Nvidia s'appuie ici sur les unités OFA (Optical Flow Accelerator) de ses GPU, pour le coup largement plus nombreuses sur les RTX 40 que les précédentes, afin d'analyser le flux optique entre deux images séquentielles dans le jeu et en déduire un "champ de flux optique". Plus clairement, il s'agit d'une cartographie sur laquelle vont être positionnées la direction et la vitesse à laquelle les pixels se déplacent entre l'image 1 et l'image 2. Les unités OFA sont en effet capables de capturer des informations au niveau d'un simple pixel, une précision que ne permettent pas les vecteurs de mouvement du moteur 3D. Ces derniers sont toutefois utilisés pour suivre les déplacements géométriques au sein de la scène. A l'aide de ces données, un modèle IA va alors générer l'image intermédiaire entre 2 images calculées. Couplée à l'uspcaler, cette technique permet de ne pas calculer mais générer jusqu'à 7/8 des pixels nécessaires (dépendant du niveau d'upscaling bien sûr) aux 2 images consécutives affichées.

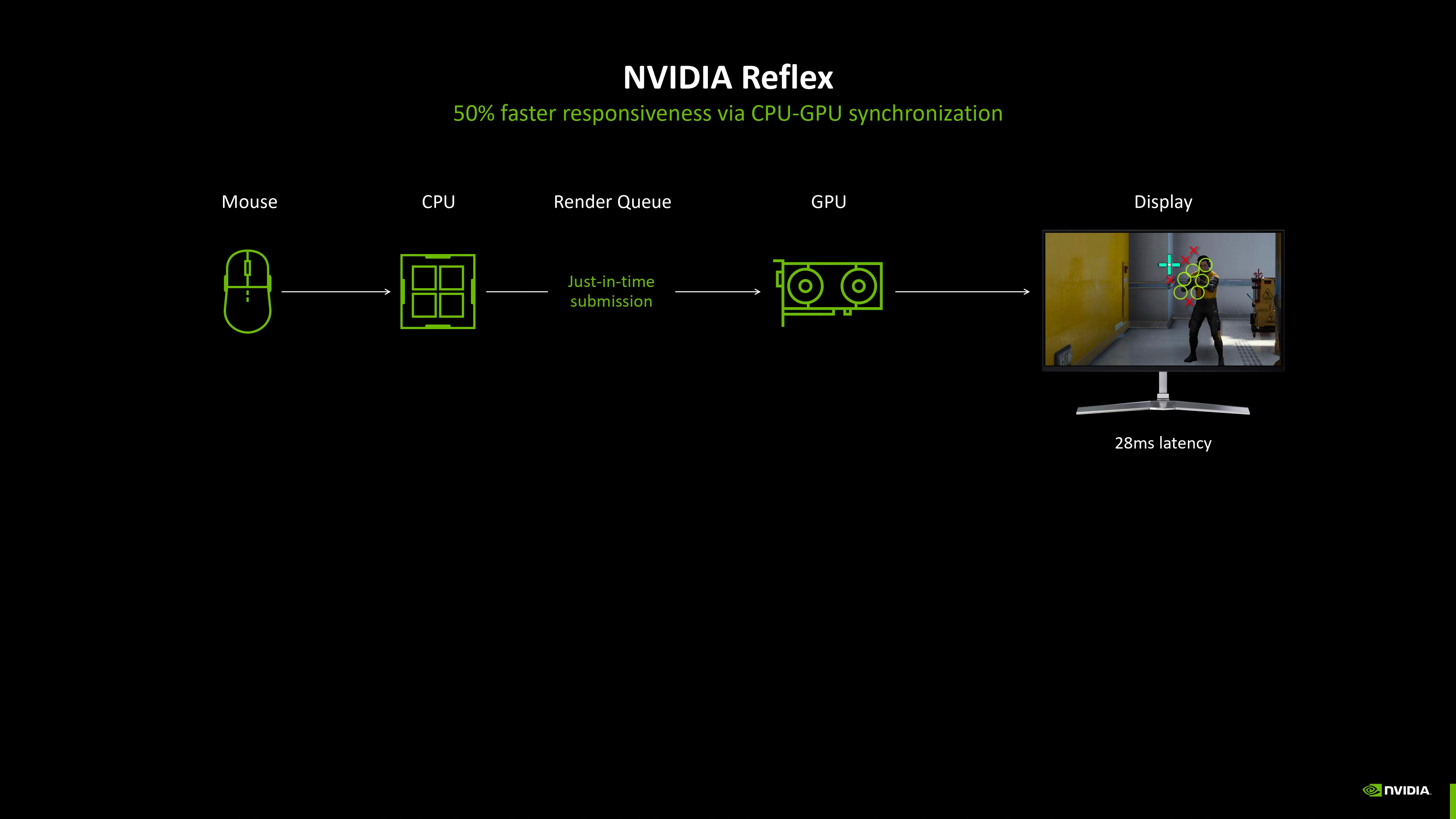

Compte tenu de l'augmentation de latence liée au principe même de fonctionnement (il faut attendre le rendu de la seconde image avant de pouvoir générer l'image à insérer entre les deux et afficher ensuite tout cela), Nvidia couple systématiquement Reflex à sa Frame Generation. Kesako ? Il s'agit en fait d'une technologie permettant d'éviter au CPU de prendre de l'avance sur le GPU au niveau de l'envoi des images à calculer par ce dernier. Cette synchronisation a pour effet de réduire notablement la latence, mais nécessite pour être efficace (et éviter les faux positifs par les mécanismes de prévention de la triche en ligne) d'être intégrée au sein même du jeu.

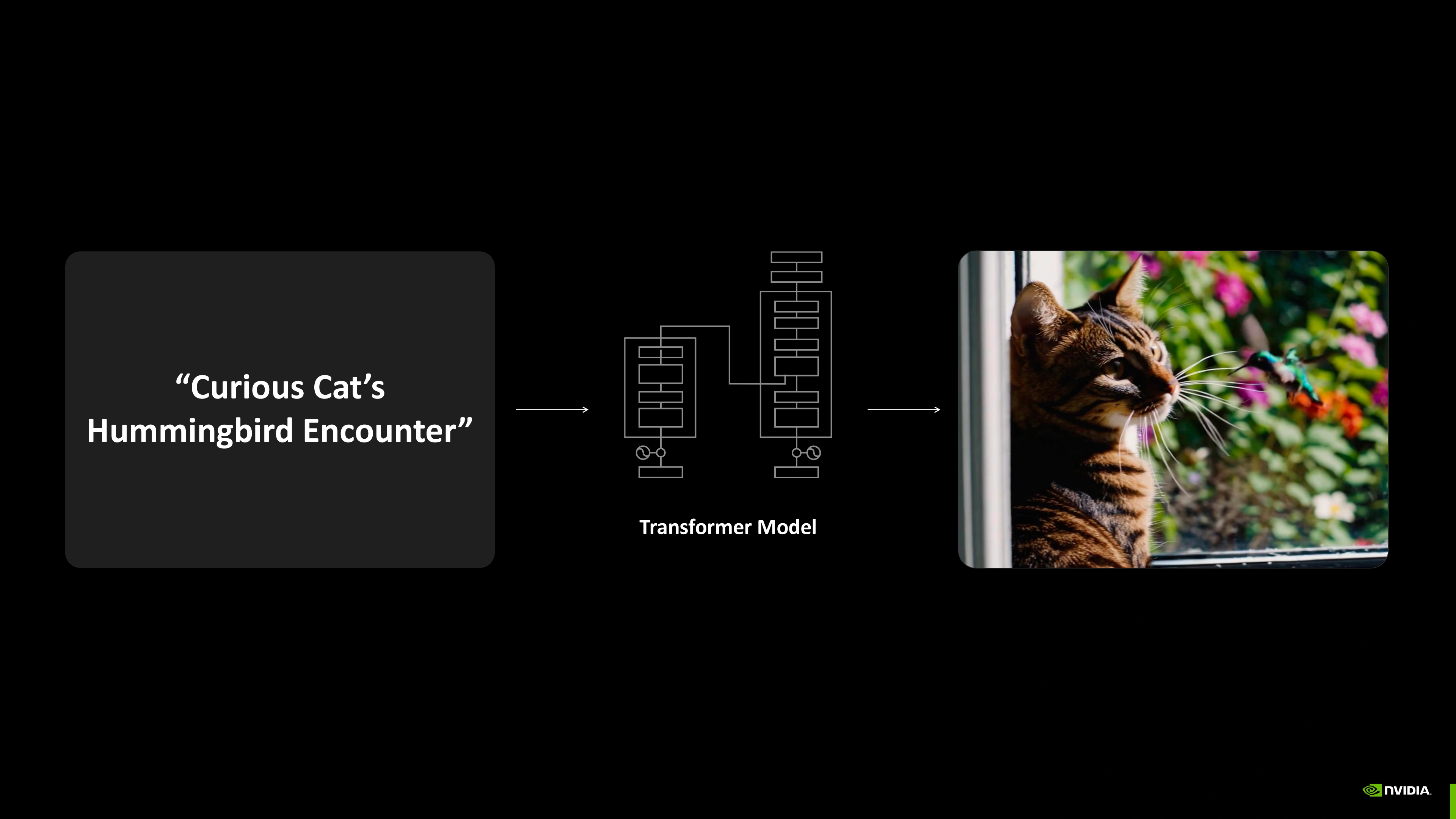

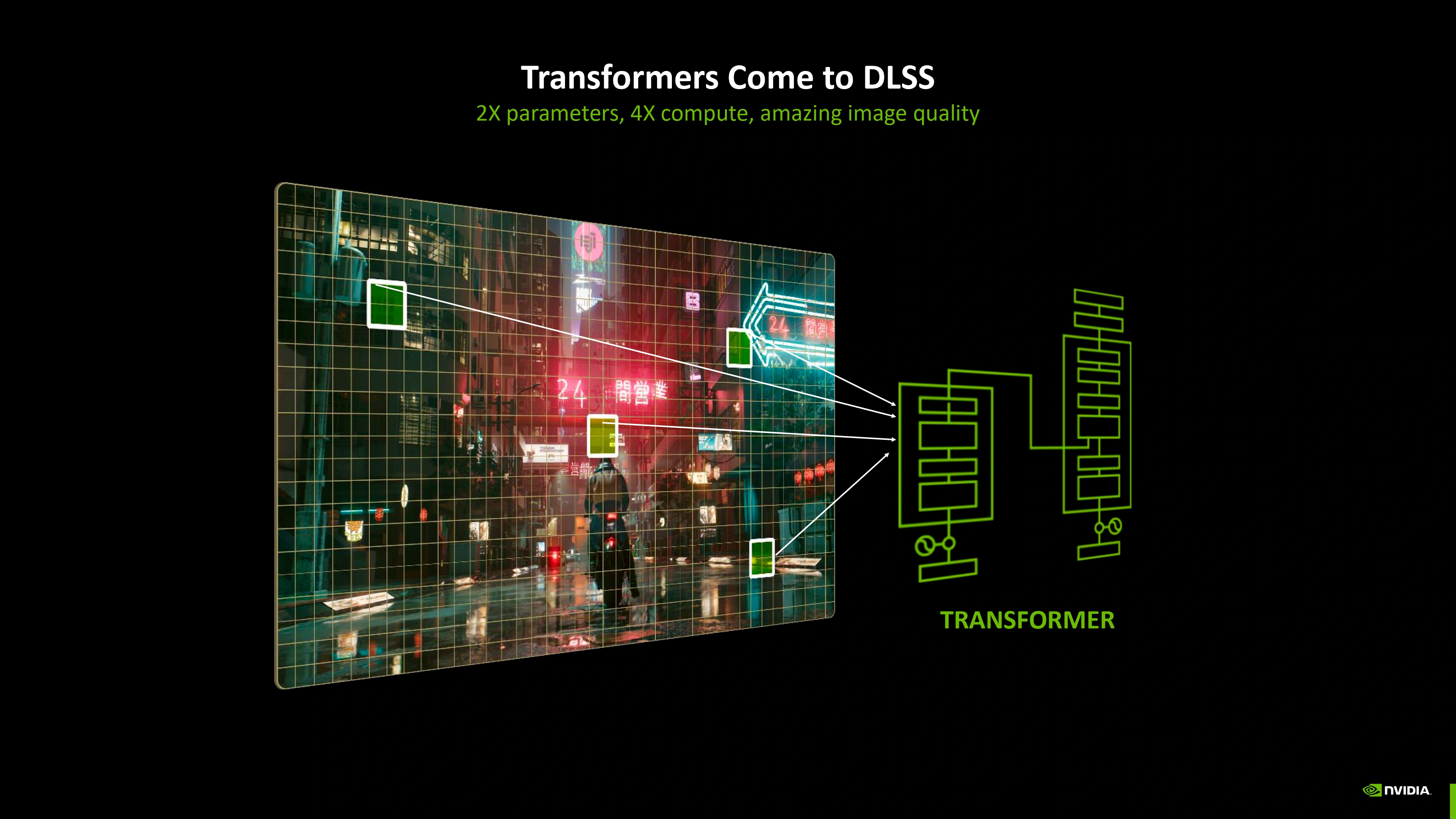

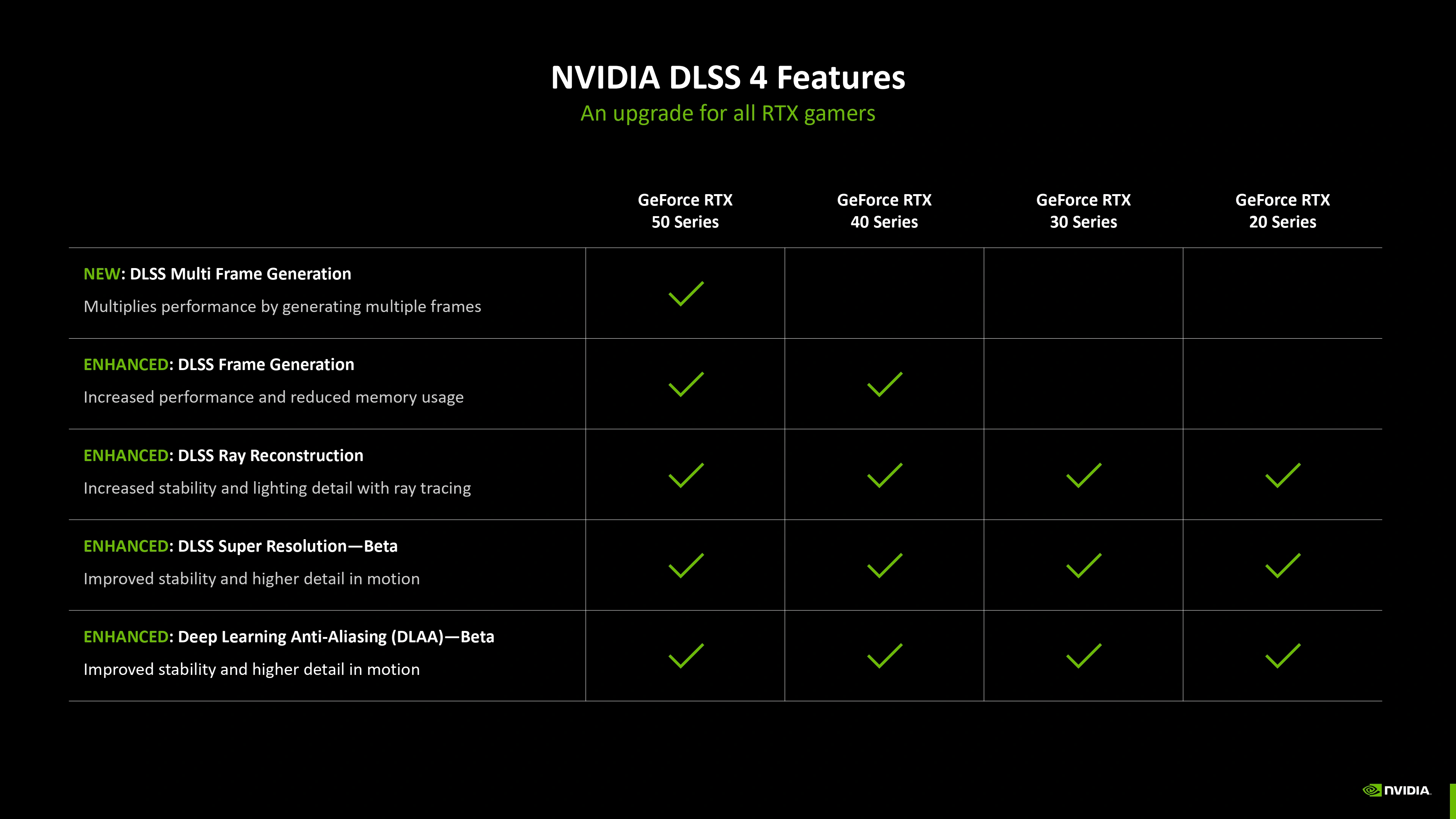

Quid du DLSS 4 à présent ? Commençons par la partie upscaling. Cette dernière subie une modification d'ampleur puisque l'on passe d'un modèle CAE / CNN à un modèle Transformer. Pour en apprendre un peu plus sur ce dernier, nous vous invitons à consulter notre dossier relatif à l'IA (effleurant juste ce vaste sujet, mais qui devrait vous permettre d'obtenir les notions élémentaires pour comprendre la nature du changement). Il innove par un mécanisme d’auto-attention (self-attention dans le jargon anglophone) permettant au réseau de se focaliser sur certains endroits jugés importants et de taille plus grande que ceux possibles via les modèles CNN précédents. Notez que ces Transformers sont la brique de base à l’œuvre dans les derniers réseaux à la mode tel Chat GPT : NVIDIA n’a donc pas fait cavalier seul ce coup-ci. Grâce à cela, les verts communiquent sur une implémentation de la reconstruction d’image 40 % plus rapide et faisant usage de 30 % de VRAM en moins, ce qui permet aux réseaux du DLSS 4 de manger 2 fois plus de paramètres en entrée pour un rendu toujours plus fidèle.

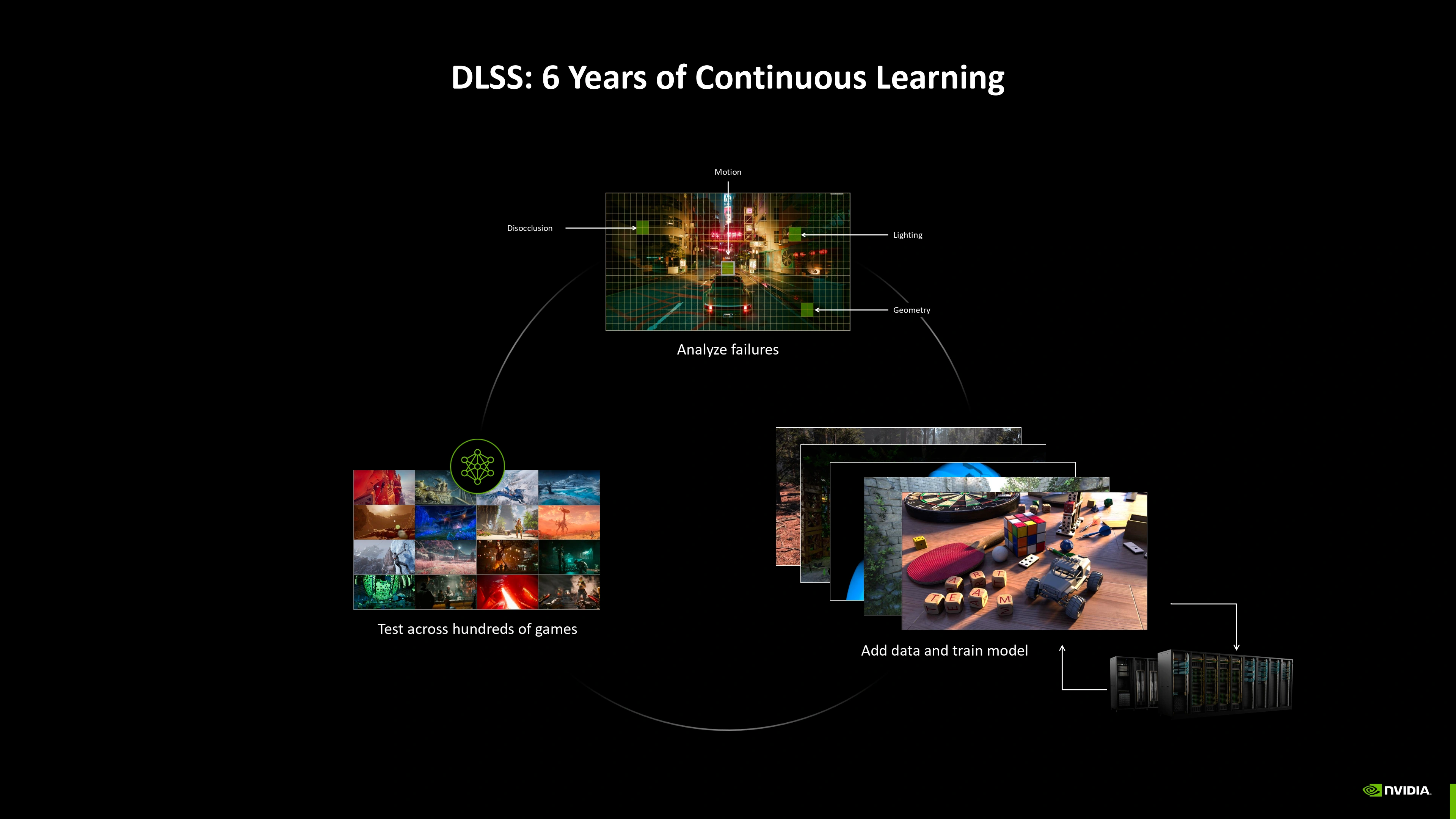

Dans les faits, les réseaux à l’œuvre dans les trois composantes de base du DLSS ont été mis à jour pour tirer partie de cette nouvelle structure : Super Resolution (l'upscaler permettant la mise à l’échelle de rendu effectué dans une définition inférieure)? Ray Reconstruction (débruitage et nettoyage du lancer de rayon) et DLAA (Anti-aliasing par IA). Dans chaque cas, le passage aux Transformers permet de limiter le ghosting (effet de rémanence de l’image précédente), améliorer la restitution des détails, ainsi que diminuer les artefacts temporels. Nvidia avance une charge computationnelle multipliée par 4, ce qui rendra le nouveau modèle certainement plus lent que le précédent sur les cartes disposant de moins de Tensor Cores ou d'itérations précédentes de ces derniers. Et si vous demandez le pourquoi d'un tel changement, les verts indiquent qu'ils ont amélioré durant 6 ans les précédents modèles CNN et qu'ils ne parviennent plus à obtenir d'évolutions visuelles significatives. Il fallait donc passer par cette étape pour franchir un nouveau palier qualitatif.

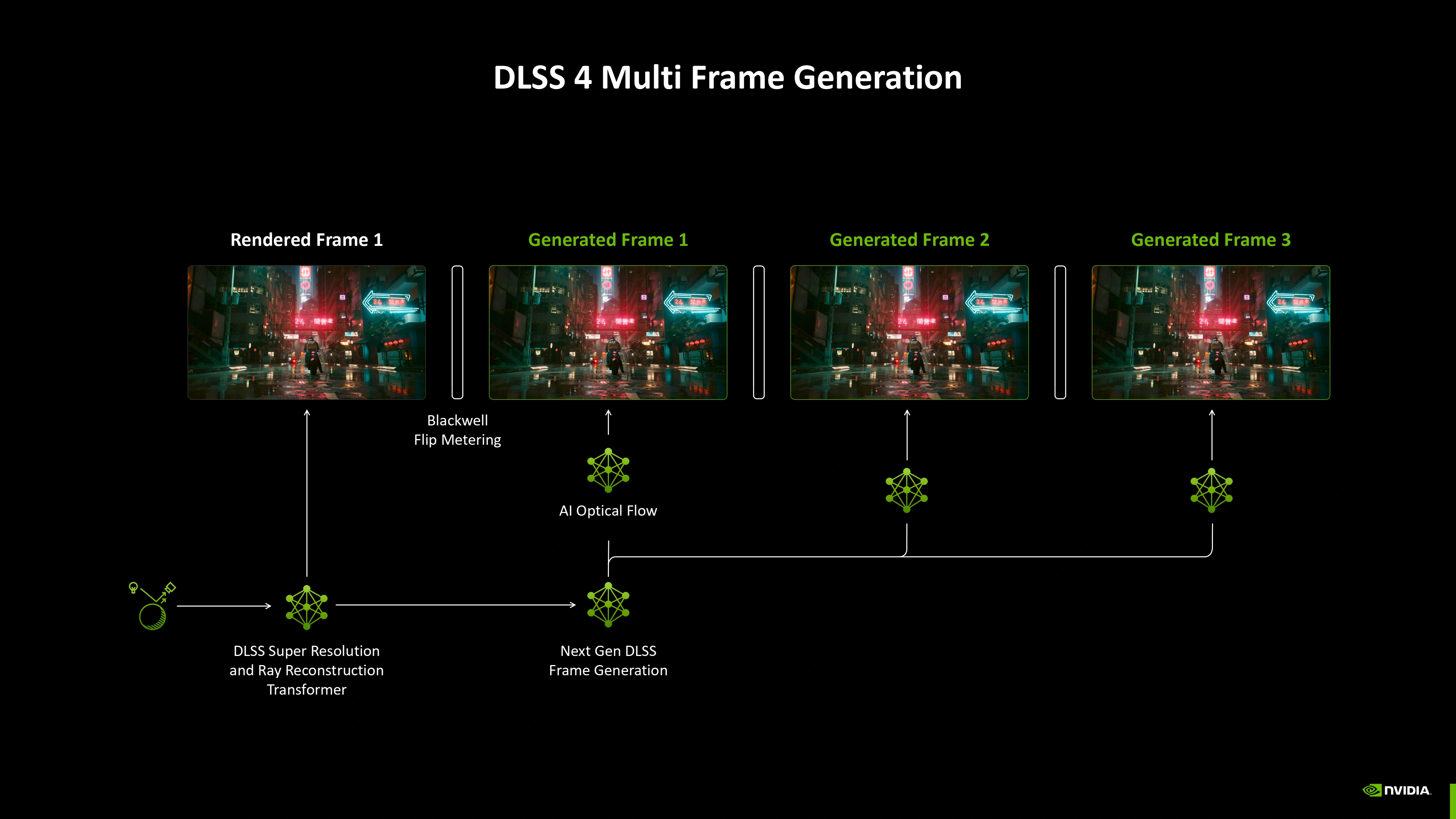

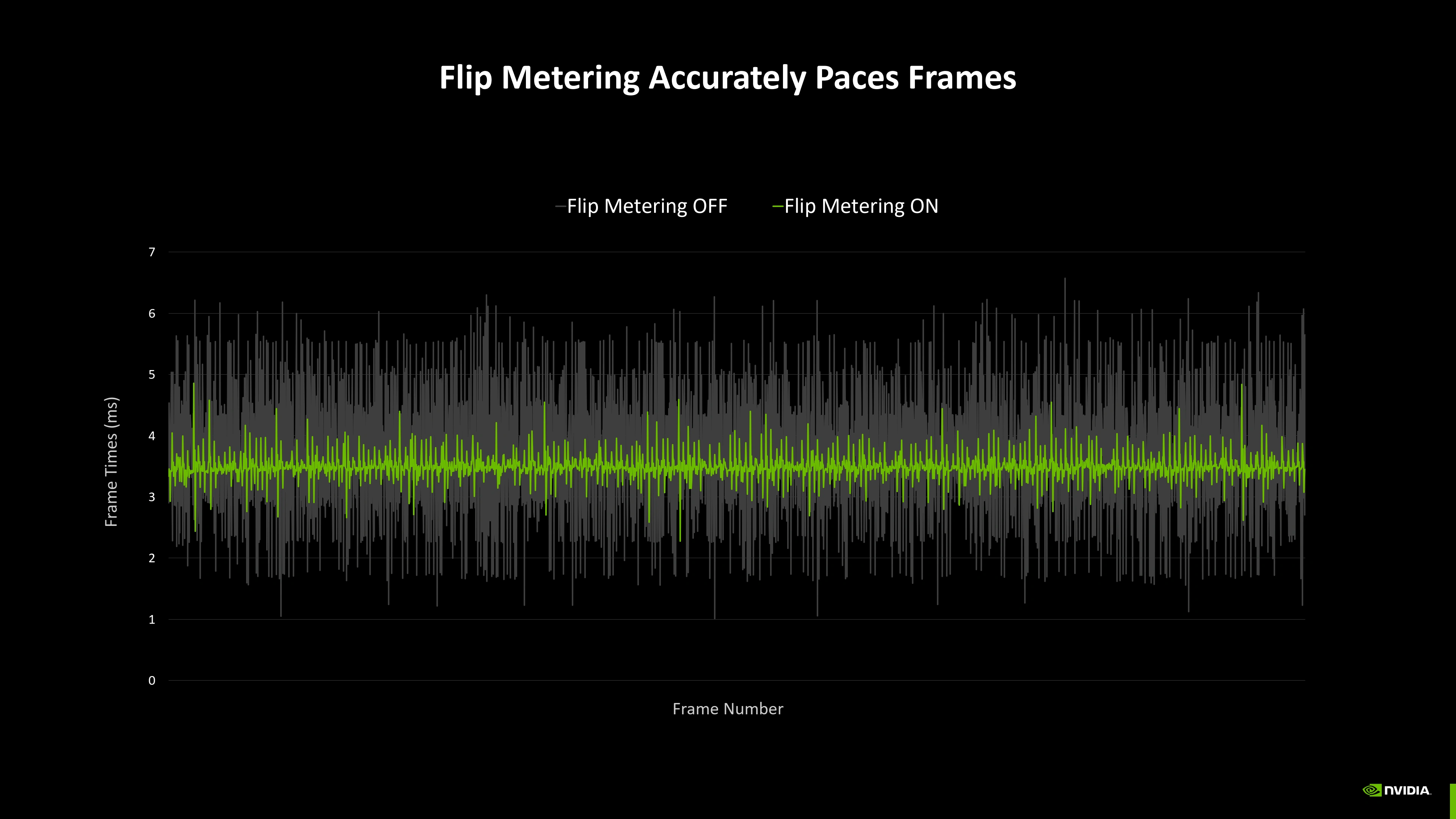

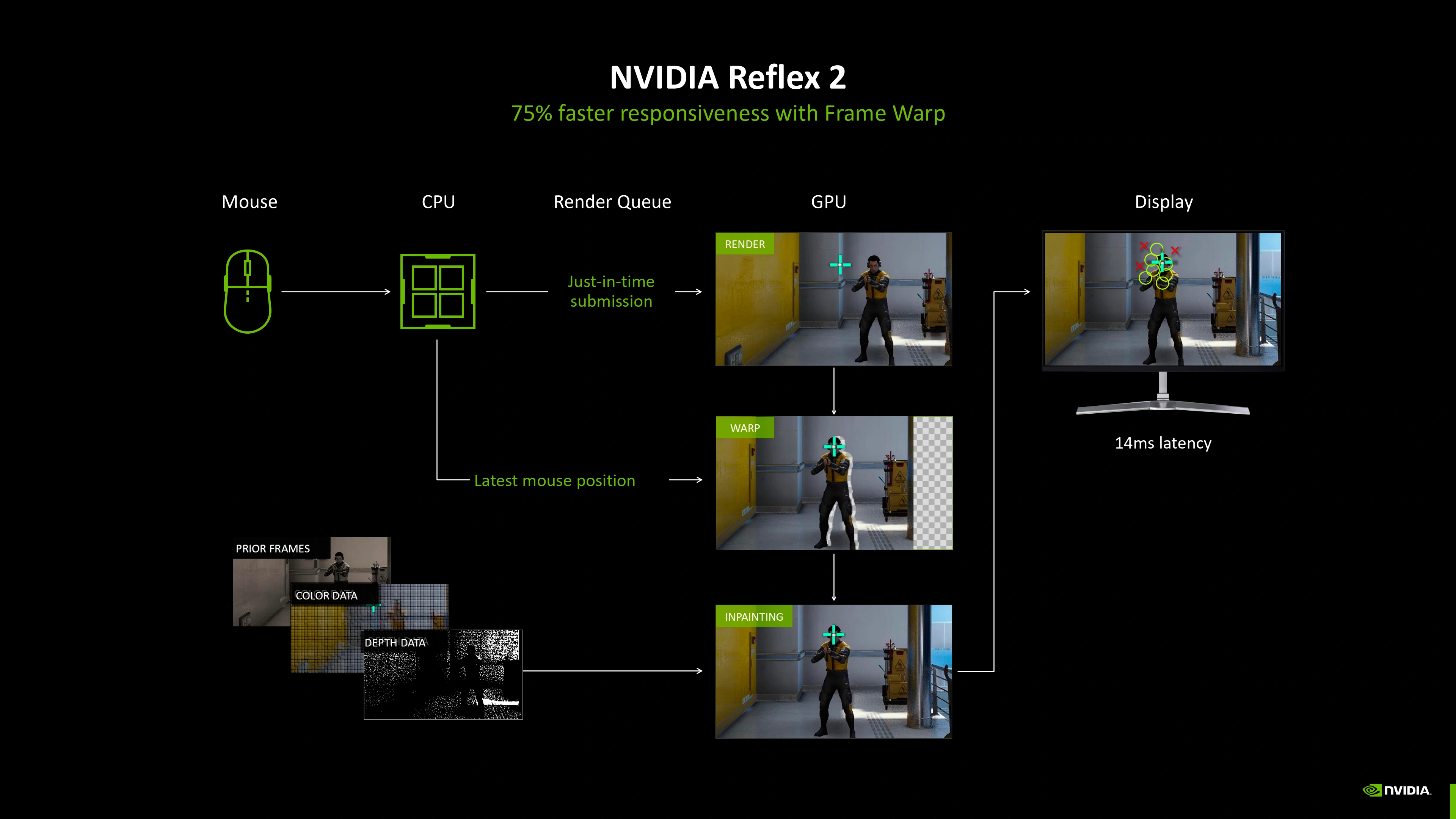

La partie Frame génération évolue aussi largement. Exit l'analyse du flux optique via les OFA, c'est à présent l'IA qui s'en charge avec l'appui des Tensor Cores. Au lieu de se contenter de générer une seule image entre deux images rendues, il est possible de passer ce nombre à 3 maximum avec la MFG (Multi Frames Generation). De quoi quadrupler les performances lorsque couplé à l'upscaling. Nvidia indique qu'il est ainsi possible de générer via l'IA jusqu'à 15/16 des pixels nécessaires pour ces images. Pour améliorer le confort de cette MFG, une technologie nommé Flip Metering permet de lisser l'envoi des images à l'affichage pour éviter les désagréables changements de rythme trop brusques. Elle s'appuie sur une composante hardware uniquement présente à partir de Blackwell, justifiant d'après Nvidia la limitation de la MFG aux seules cartes de cette génération. Par contre ce changement d'approche pour la Frame Generation (2x = une seule image insérée), pourrait potentiellement l'ouvrir aux générations antérieures à Ada Lovelace, puisque le débit des OFA n'est plus problématique, reste à voir si celui des Tensor Cores de Turing et Ampere l'est. Mais laissons là ces supputations et finissons par Reflex 2, qui permettrait de son côté d'améliorer encore la latence selon Nvidia via la technique de Frame Warp. Nous détaillerons cela une fois disponible.

Jetons à présent un œil à la mise en pratique du DLSS 4. Nvidia annonce pas moins de 75 jeux disponibles à la commercialisation des RTX 5080/5090. De notre côté, nous n'avons pu accéder qu'à 6 d'entre eux en version anticipée. Pour atteindre ce nombre, la stratégie des verts s'appuie sur 2 piliers : une intégration native au jeu via un patch des développeurs. C'est la solution préférentielle, mais comme cela dépend de la réactivité des acteurs, Nvidia propose une alternative qui permettra l'activation du nouveau modèle Transformer ou de la Multi Frame Generation au travers d'options intégrées à Nv App. Pour ce faire, il faudra que le jeu dispose déjà d'une implémentation préalable du DLSS (quelle que soit sa version) et que les verts aient validé le jeu pour cela au sein de Nv App. Qui plus est, cela ne permettra pas non plus d'activer la MFG pour un jeu qui n'aurait pas implémenté au préalable la Frame Generation originelle du caméléon.

Jeux compatible DLSS 4 "day 1"

Jeux compatible DLSS 4 "day 1"

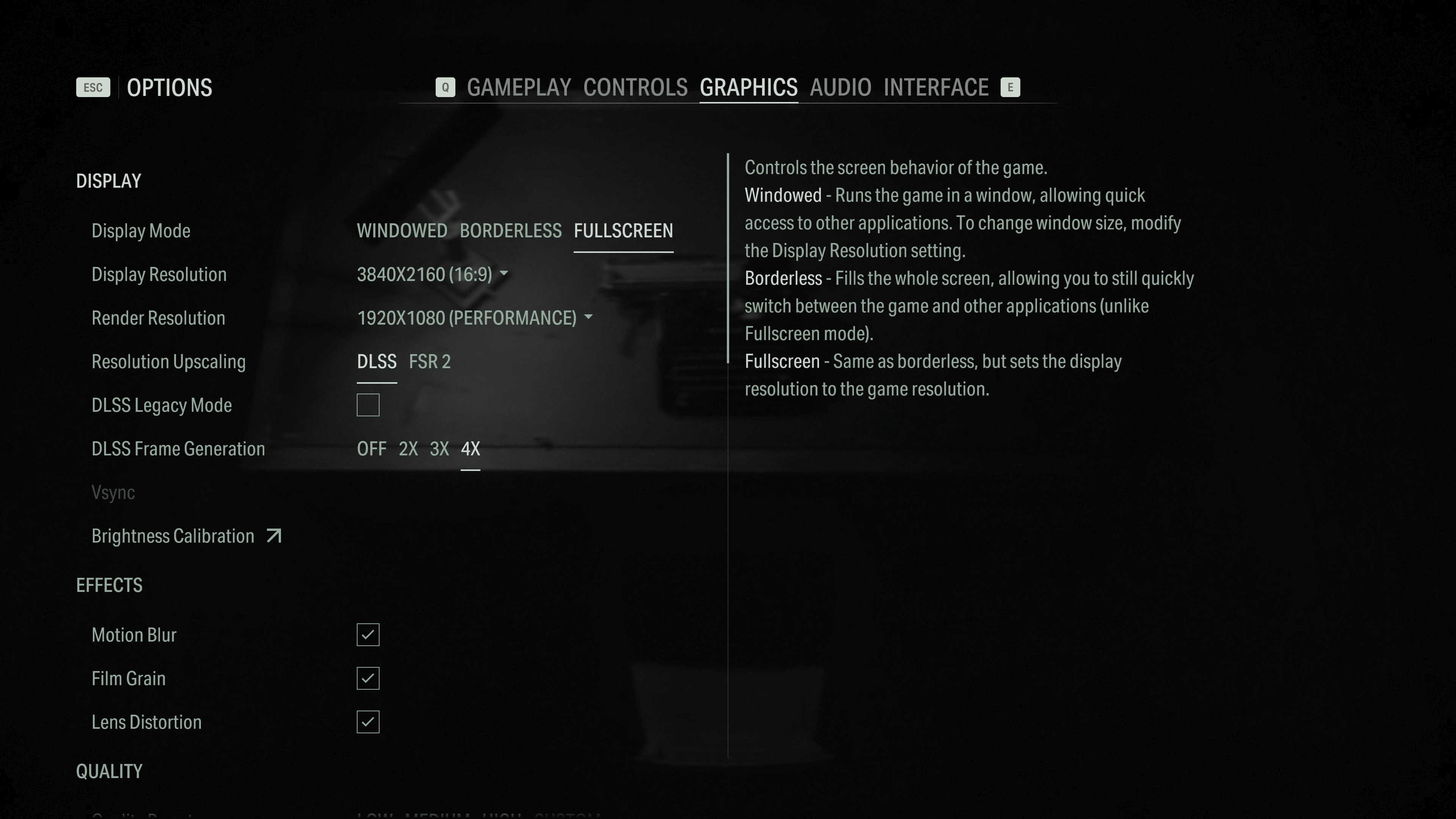

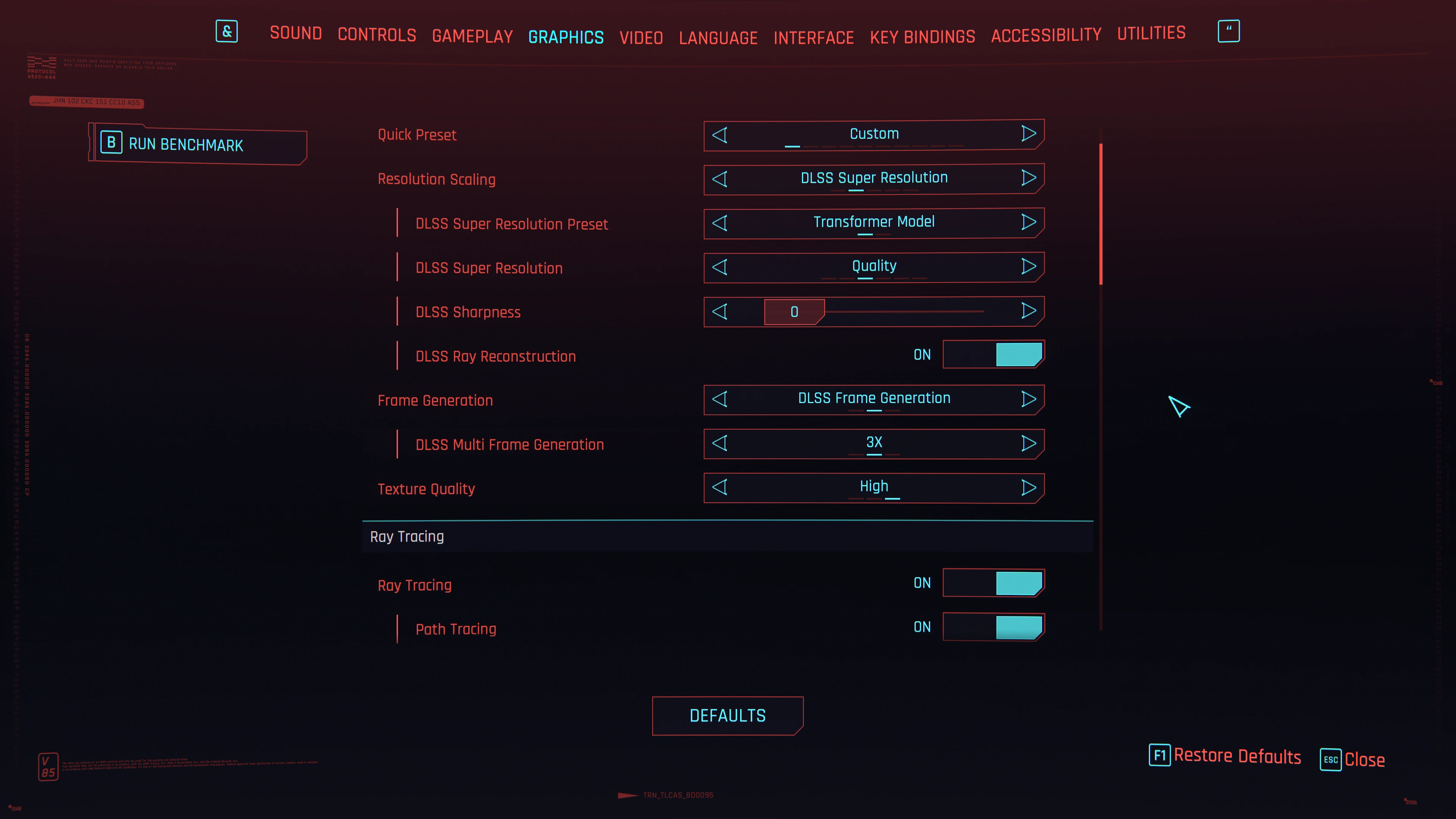

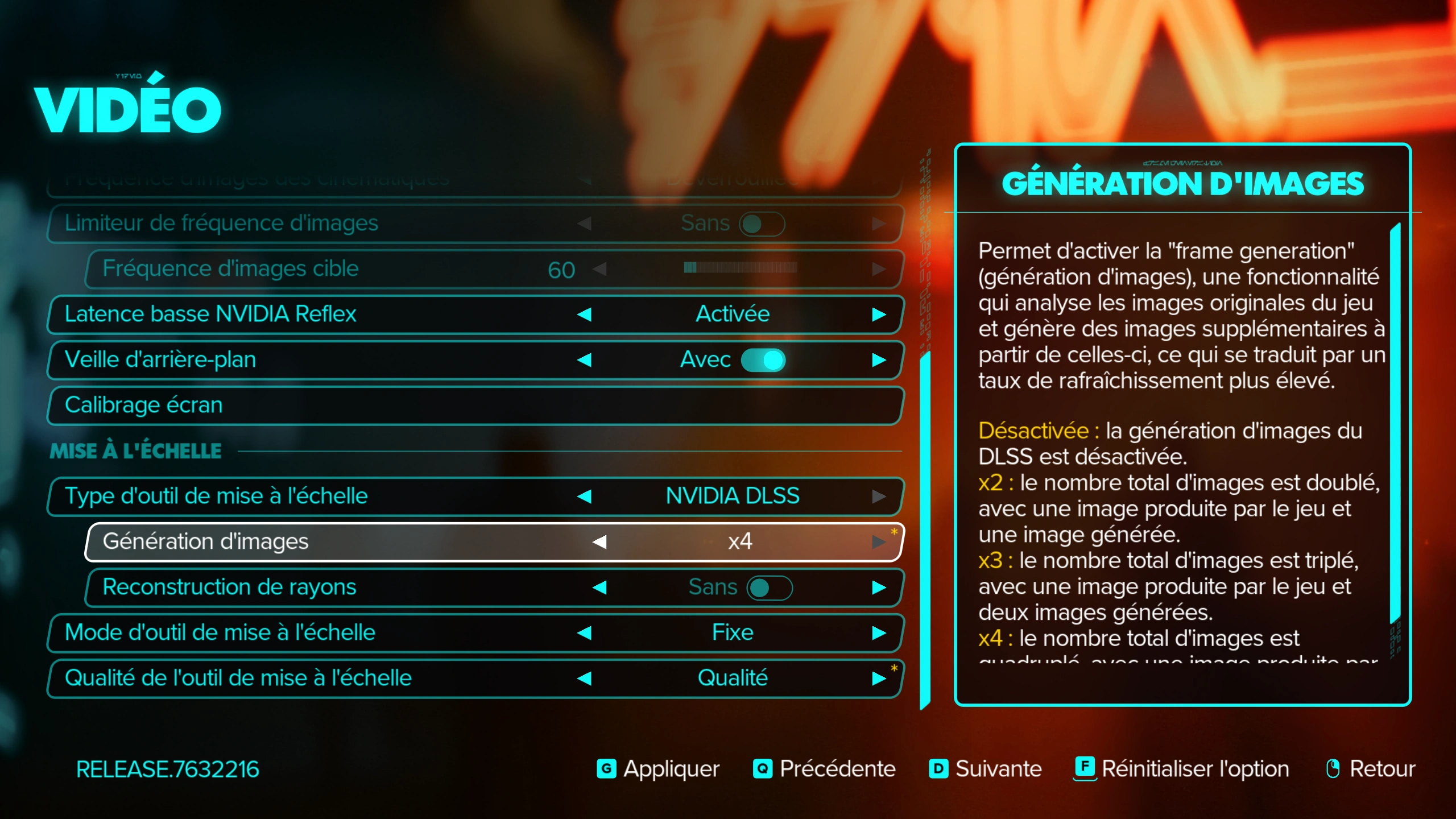

Nous avons essayé les 2 méthodes pour nous assurer de leur fonctionnement. Ainsi, nous avons eu accès à des branches bêta d'Alan Wake II, Cyberpunk 2077 et Star Wars Outlaws illustrant l'implémentation native. AW2 active par défaut le modèle Transformer mais vous propose une option à cocher pour revenir au modèle précédent. La MFG est activable et la build de test disposait aussi de la prise en charge de la Mega Geometry. CP2077 propose la même chose (hormis la Mega Geometry) et il en est de même pour SWO, même si la version bêta ne permettait pas de revenir au modèle précédent pour le DLSS (uniquement Transformer).

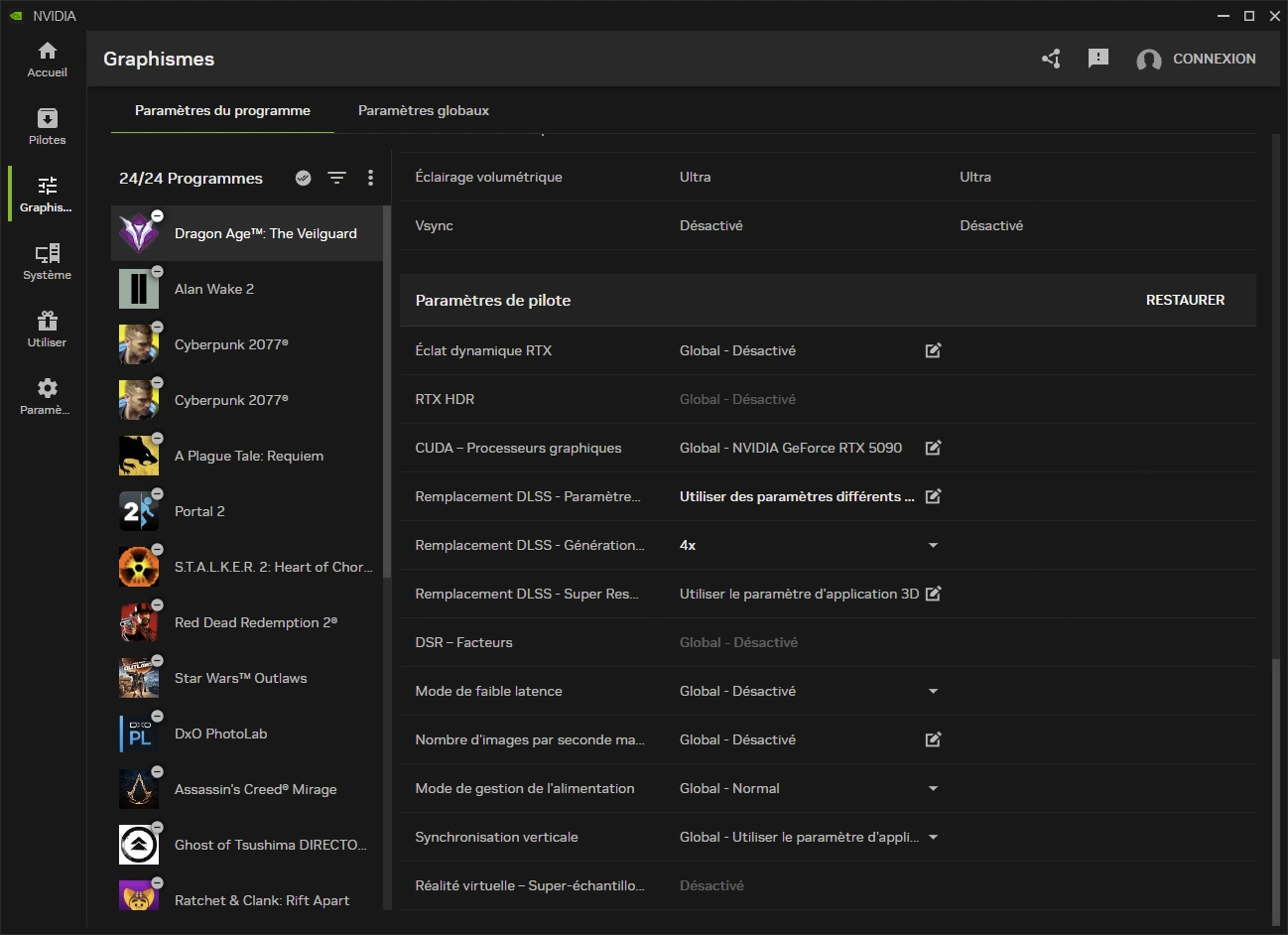

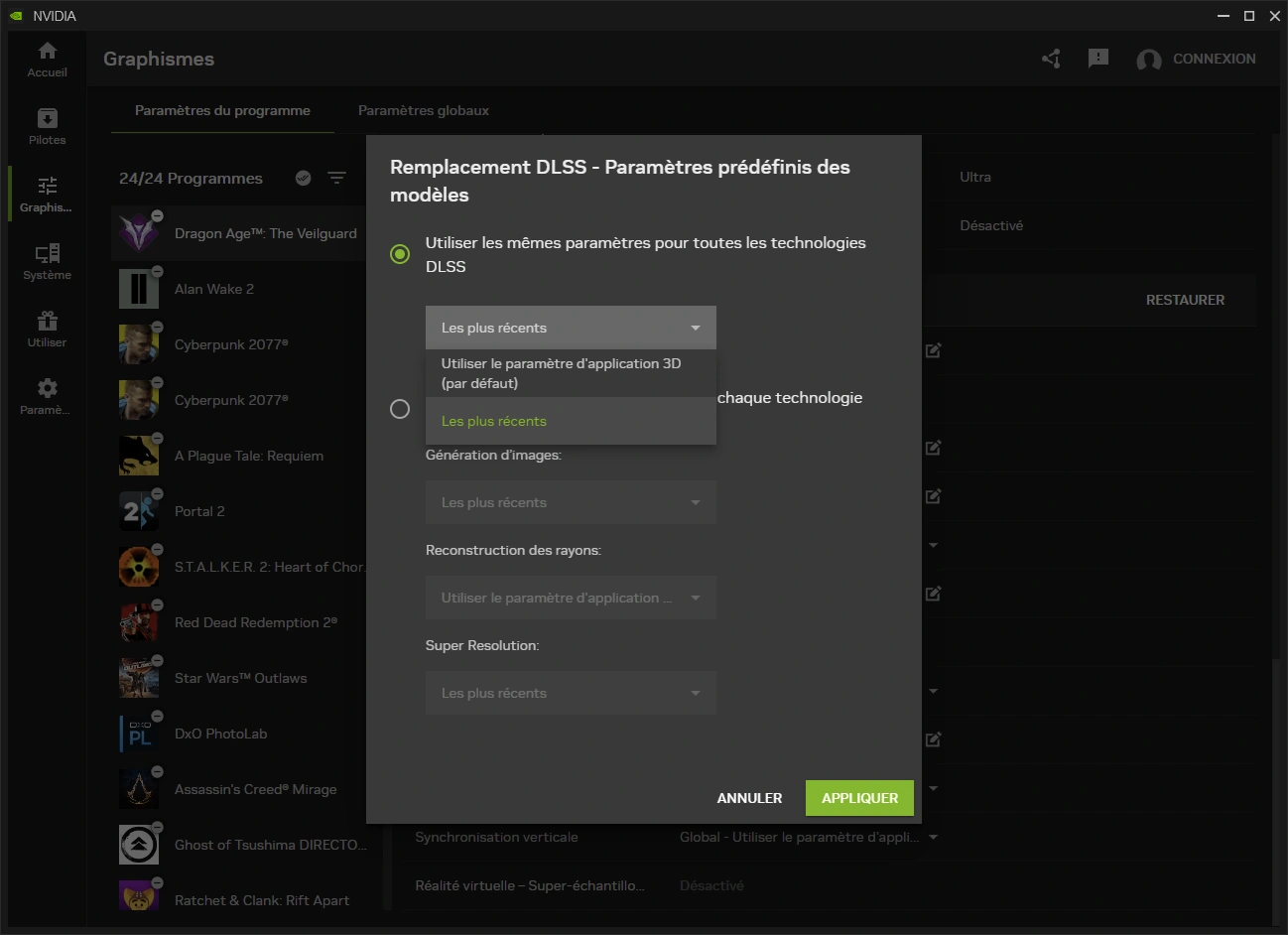

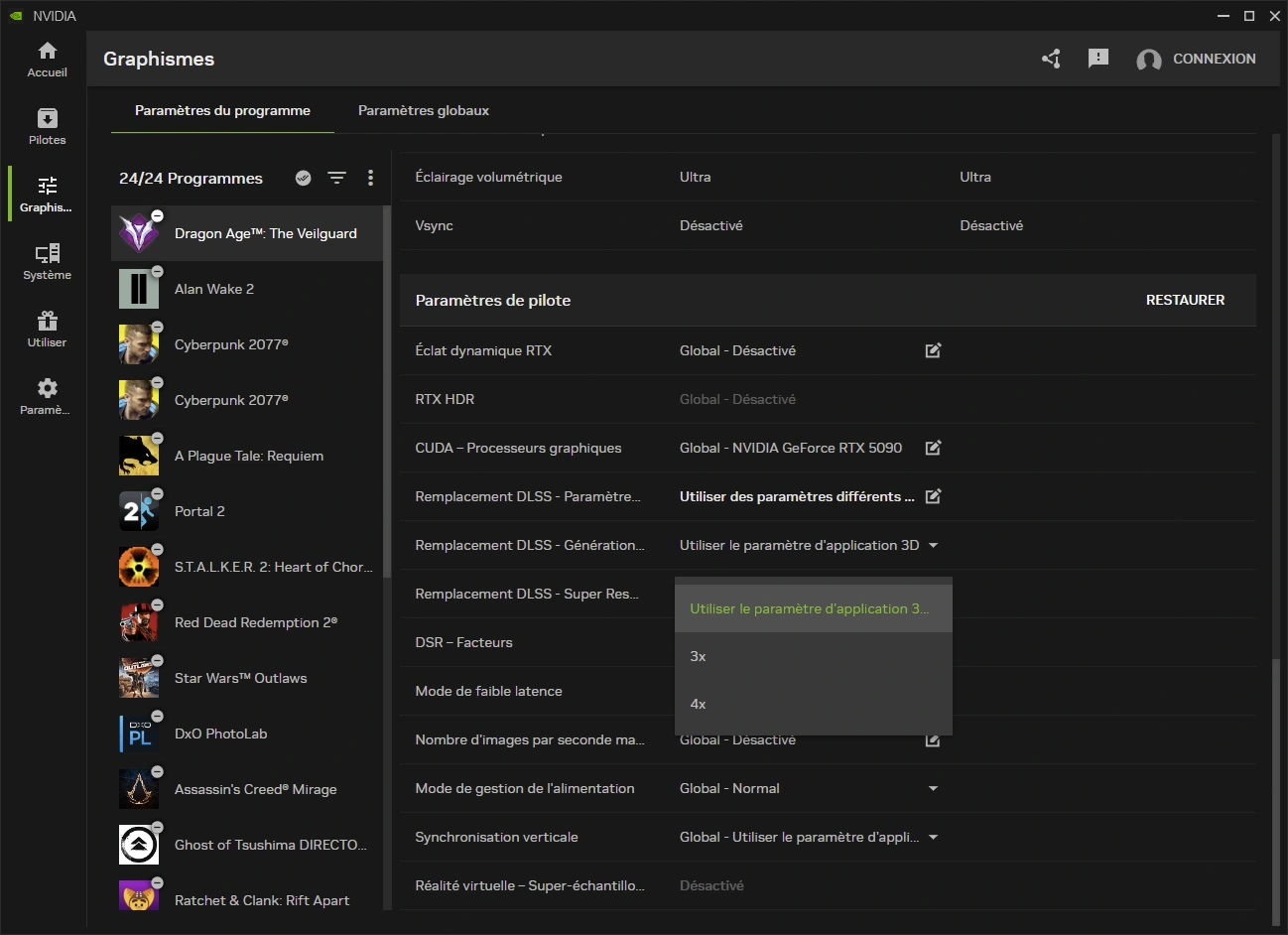

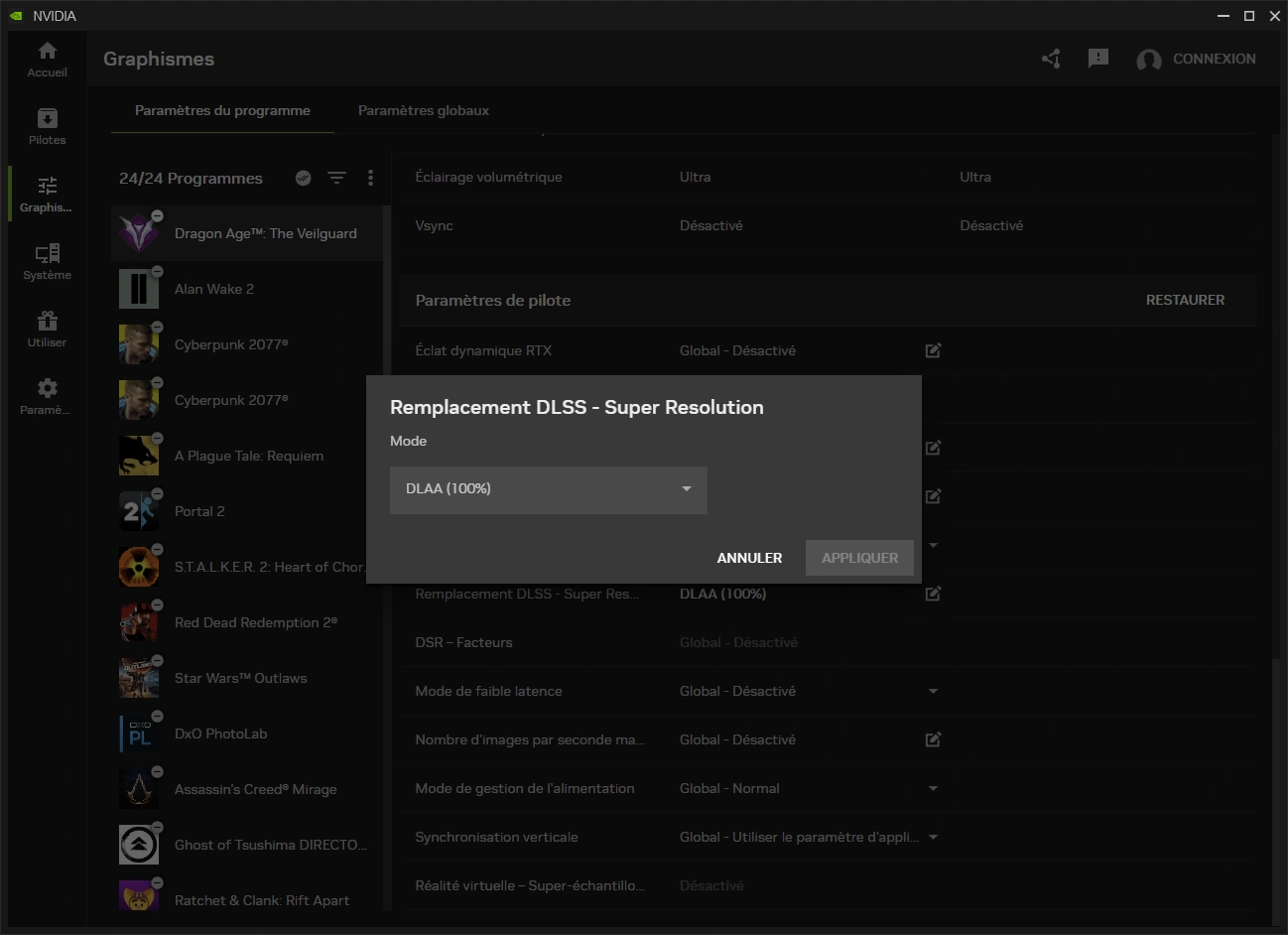

Dragon Age: The Veilguard peut de son côté utiliser le DLSS 4 via la technique de remplacement. Via Nvidia App, il est donc possible de changer le modèle (choisir "le plus récent" pour obtenir Transformer), mais aussi la Multi Frame Generation ou encore forcer le DLAA (s'il n'est pas proposé nativement dans le jeu). Cette technique fonctionne tout aussi bien que la native des exemples précédents, tout du moins avec ce jeu.

Et côté prestations ? Pour mesurer cela, nous avons sur les 4 jeux précédents, mesuré le niveau de performance en faisant varier les différents réglages. L'upscaler version Transformer se montre performant, puisqu'il permet en mode qualité un gain compris entre 65 et 107 % en UHD (le niveau d'upscaling n'est pas systématiquement identique entre titres malgré le choix qualité systématique). L'activation de la MFG amplifie ce phénomène et le nombre d'images par seconde explose littéralement. Malgré cela, le ressenti n'est pas aussi impressionnant que sur RTX 5090 sur certains jeux, en particulier pour Alan Wake 2. La fluidité n'est pas en cause, mais on ressent une certaine lourdeur absente sur sa grande sœur (nous en reparlerons un peu plus bas).

DLSS 4 - Moyenne - MFG - RTX 5080 FE

Les 1% Low profitent également très largement de ces technologies, confirmant un réel confort visuel. Le Frame Pacing est également sous contrôle du fait du transfert de sa responsabilité au GPU (au lieu du CPU), de sorte que la plupart des effets négatifs de la Frame Generation au niveau de la fluidité sont gommés ou à tout le moins atténués.

DLSS 4 - 1% Low - MFG - RTX 5080 FE

C'est bien beau d'avoir un nombre d'images par seconde qui explose, mais quid de la pénalité côté latence, qui va conditionner la réactivité du jeu à vos actions ? S'il existe bien une pénalité, cette dernière est contenue. et le résultat est toujours bien meilleur qu'en rendu natif. Toutefois, la RTX 5080 étant moins puissante que la 5090 de base, on ne retrouve pas exactement la même sensation de réactivité avec ces réglages ultra exigeants dans cette définition. En fait, on part de trop bas au niveau des images par secondes avant MFG, c'est particulièrement le cas pour Alan Wake II.

Au jugé, il nous semble nécessaire d'obtenir à minima entre 40 et 45 i/s avant d'activer la MFG, pour obtenir une sensation de jeu confortable. Il est donc utile d'adapter les réglages pour atteindre ce seuil, ou opter pour un upscaling plus agressif (Intermédiaire ou Performance à la place de Qualité), sachant que le modèle Transformer permet d'atténuer considérablement la dégradation visuelle entre ces réglages (en particulier avec une définition cible UHD). Cela démontre aussi que la notion de gamme existe toujours et que le MFG ne permet pas de transformer un GPU d'entrée de gamme en monstre tout puissant.

DLSS 4 : Latence - MFG - RTX 5080 FE

Reste à aborder le côtés plus subjectif de la chose : la qualité visuelle. Si notre ressenti global est excellent en première approche (et dans le temps imparti très limité pour se faire une opinion sur le sujet), le nombre de titres compatibles reste limité durant cette phase de test. Des essais plus approfondis que nous pratiquerons dans les semaines / mois qui viennent permettront d'affiner cela. De par son principe d'apprentissage, le modèle Transformer va se bonifier avec le temps, d'ici là nous tâcherons d'évaluer la qualité visuelle au sein des titres disponibles. Tout ceci prenant beaucoup de temps (déjà phagocyté par les tests des cartes), nous vous proposerons des mises à jour à ce sujet dès que possible. il est temps de passer aux nuisances sonores de la carte page suivante.

Merci!

Merci pour le test.

Une génération à oublier pour moi, tant les gains ne sont pas significatifs.

Le MFG est quand même intéressant.

très bon test comme toujours

dommage ça stagne un peu

il manque une 5080 ti avec un gb202 castré en bus 384 bits gros écart entre les 2 50

le modèle fe n'a apparemment plus de metal liquid et a délaissé aussi la chambre a vapeur pour des caloduc "simple" du coup bien que la consommation baisse pas mal le bruit s'améliore de très peu et la carte reste un peu audible

je me doute que nvidia a voulu / doit faire des économies mais c'est une carte a quand meme 999 $ j'aurais plus vu une chambre a vapeur simplifié mais chambre a vapeur tout de meme

la version caloduc serait plus allé pour une 5070 ti si elle avait existé

vivement une nouvelle gravure pour plus de nouveauté j'aurais appelé cette gen rtx 45 plus que 50 au vu des maigre améliorations

Je viens d'ajouter le lien vers les pages du démontage de la carte par TPU.

c'est la ou j'ai vu

C'est de la bonne came

Autant la 4080 elle etait un peu juste pour remplacer une 3080, autant une 5080 ca fait du X2 partout, meme au niveau du debit DisplayPort, ca tombe bien, c'est ce que je demande pour un upgrade

Je vais peut etre attendre les modeles 24Go quand meme, pour le futur c'est mieux

Merci pour cet excellent banc d'essai !

Malheureusement, il démontre la totale inutilité de Blackwell, en tout cas à ce niveau de la gamme.

Espérons que les 5070(Ti) ferons nettement mieux que les 4070(Ti) Super, sinon on voit vraiment mal l'intérêt des RTX 5000, et la RTX 5090 aurait tout aussi bien pu être la seule dans la gamme, voire être référencée comme RTX 4090 Titan...

Aucune chance qu'elle fasse nettement mieux, avec ses spécifications officielles publiées par NVIDIA. Ce sera certainement un bond nettement inférieur au refresh 4070 Ti => 4070 Ti Super. De toute façon, à partir du moment où NVIDIA a annoncé qu'ils utilisaient le même procédé de gravure que les RTX 4000, il n'y avait pas grand chose à espérer. Maxwell en 28nm bien meilleur que Kepler aussi en 28nm fut plutôt une exception.

On se répète, mais merci pour le test les copains !

Aucune surprise sur le test d'une objectivité incroyable......

Bon je vais attendre quelques mois pour remplacer ma 3080 ti, merci nividia de proposer une 5080 à un tarif intéressant.

Merci pour le test, très intéressant.

Bon au final à part en 4K et MFG rien de neuf. Un peu déçu ! Et on peu presque affirmer que la 5070 Ti n'ira pas chercher la 4080 Super.

Vivement un test de la 5070, 5060Ti et les AMD à côté pour potentiellement une guerre de prix. Qui sait.

Côté dissipation, le rad de la 5090 sur la 5080 marche plutôt bien !

Et le MFG c'est vraisemblablement pas fou selon les jeux, j'ai vu quelques comparatifs et ça pêche sur la qualité et le nombre d'artefact ça me semble bien loin des standards de qualité habituels de Nvidia 😬

C'est encore en bêta apparemment

Mais l amélioration de la qualité hors génération de frame c'est pas mal

C'est un peu la douche froide mais lorsque tu compares les spécifications du flagship et de la cadette c'est plutôt normal. La bataille se fera donc sur le MDG et je pense qu'AMD le savait depuis le début. Dans 2 mois on aura tous les éléments pour choisir et RTX 5090 mis à part l'écart va se resserrer entre les 2 constructeurs tout du moins sur ces 12 premiers mois. Nvidia devra vite sortir une gamme Super et une 5080 Ti pour reprendre 1 génération d'avance sur AMD sur le MDG.

C'est une 5070. une honte.