Navi 33

Pour ceux intéressés par l’architecture RDNA 3, nous vous renvoyons aux pages que votre serviteur/rédacteur lui avait consacrées, alors qu’il sévissait au sein d’un autre média. Comme nous l’indiquions en débutant ce dossier, AMD utilise le GPU Navi 33 pour animer la RX 7600. Son die est de taille plutôt modeste, puisque se limitant à 204 mm². Par rapport à Navi 23 (237 mm²), son pendant en RDNA 2, il n’utilise que 86 % de sa superficie tout en augmentant de presque 20 % le nombre de transistors embarqués. Cela s’explique par la transition effectuée au niveau du procédé de gravure, passant d’un 7 nm TSMC vers une version 6 nm. Comme toujours, ces dénominations sont avant tout commerciales, puisque les 2 procédés font partie du même nœud (à contrario du 5 nm par exemple), mais avec des ajustements et optimisations. Ce que l’on constate ici, c’est que la densité est en progrès très notable (+ 40%), malgré un nœud de gravure identique. Le procédé de fabrication a bien entendu été amélioré par rapport au 7 nm utilisé pour RDNA 2, mais cela témoigne aussi des efforts d’AMD au niveau du design de la puce et de la constitution de cette dernière. Les rouges ont en effet particulièrement accru la capacité de calcul via l’implémentation du Dual issue sur RDNA 3, or ces unités sont particulièrement denses en termes de transistors, expliquant aussi cette densité en hausse notable.

| Gravure |

GPU |

Nombre de transistors | Superficie Die | Densité (Millions de transistors / mm²) |

|---|---|---|---|---|

| 4N TSMC | AD102 | 76,3 Milliards | 608,5 mm² | 125,4 |

| 4N TSMC | AD106 | 22,9 Milliards | 187,8 mm² | 121.9 |

| 4N TSMC | AD104 | 35,8 Milliards | 294,5 mm² | 121,6 |

| 4N TSMC | AD103 | 45,9 Milliards | 378,6 mm² | 121,2 |

| 4N TSMC | AD107 | 18,9 Milliards | 158,7 mm² | 119,1 |

| 5 nm + 6 nm TSMC | Navi 31 | 57,7 Milliards | 522 mm² | 110,5 |

| 7 nm TSMC | GA100 | 54.2 Milliards | 826 mm² | 65,6 |

| 6 nm TSMC | Navi 33 | 13,3 Milliards | 204 mm² | 65,2 |

| 6 nm TSMC | ACM-G10 | 21,7 Milliards | 406 mm² | 53,4 |

| 7 nm TSMC | Navi 21 | 26,8 Milliards | 520 mm² | 51,6 |

| 7 nm TSMC | Navi 22 | 17,2 Milliards | 335 mm² | 51,3 |

| 7 nm TSMC | Navi 23 | 11,1 Milliards | 237 mm² | 46,8 |

| 6 nm TSMC | ACM-G11 | 7,2 Milliards | 157 mm² | 45,9 |

| 8 nm Samsung | GA102 | 28,3 Milliards | 628,4 mm² | 45 |

| 8 nm Samsung | GA104 | 17,4 Milliards | 392 mm² | 44,4 |

| 8 nm Samsung | GA106 | 12 Milliards | 276 mm² | 43,5 |

| 7 nm TSMC | Navi 10 | 10,3 Milliards | 251 mm² | 41 |

| 7 nm TSMC | Vega 20 | 13.2 Milliards | 331 mm² | 39,9 |

| 16 nm TSMC | GP102 | 12 Milliards | 471 mm² | 25,5 |

| 14 nm GF | Vega 10 | 12.5 Milliards | 495 mm² | 25,3 |

| 16 nm TSMC | GP100 | 15,3 Milliards | 610 mm² | 25,1 |

| 12 nm TSMC | TU104 | 13,6 Milliards | 545 mm² | 25 |

| 12 nm TSMC | TU102 | 18,6 Milliards | 754 mm² | 24,7 |

| 12 nm TSMC | TU106 | 10,8 Milliards | 445 mm² | 24,3 |

Navi 33 intègre donc selon AMD 13,3 milliards de transistors, soit un déficit de 30 % par rapport à AD107 (probablement utilisé sur la RTX 4060), et ce malgré une superficie 29 % moindre pour ce dernier. C’est là toute la différence entre les 2 nœuds de gravure de TSMC. Il faudra donc faire avec pour AMD, difficile à dire de toute façon laquelle des 2 puces est la moins onéreuse à produire, sans connaitre les prix de chaque Wafer et les rendements associés. Le 6 nm (nœud 7 nm) est toutefois bien moins onéreux que le node 5 nm. Il est donc probable que malgré la superficie par die plus élevée (nécessitant donc plus de Wafers pour la même quantité de puces), l’option d’AMD soit la moins coûteuse. Ceci dit, le prix d'une carte ne se limite pas à celui de son GPU et d’autres éléments peuvent contrebalancer cela (si consommation plus élevée, il faudra alors un étage de puissance et un refroidisseur plus chers, etc.). Quid de la composition du GPU à présent ?

| Navi 33 | RX 7600 |

|---|---|

| Shader Engine | 2 |

| CU | 32 |

| SP | 2 048 |

| FP32 | 4 096 |

| TMU | 128 |

| AI Accelerators | 64 |

| Ray Accelerators | 32 |

| ROP | 64 |

| L2 (Mo) | 2 |

| L3 (Mo) | 32 |

| Bus mémoire (bits) | 128 |

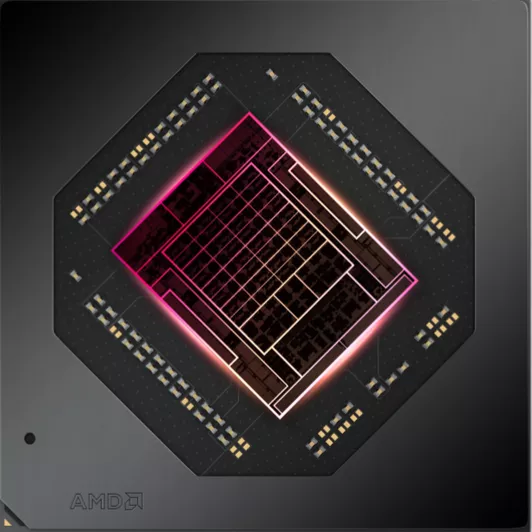

Un rendu du die de Navi 33

AMD ne fournissant aucun diagramme de blocs concernant son nouveau GPU et se montrant pour le moins peu loquace sur sa constitution, les éléments qui vont suivre sont issus de nos déductions vis-à-vis des éléments fournis, des éléments connus de RDNA 3 et d’un brin de jugeote. Navi 33 reprendrait donc la structure de Navi 23, avec 2 Shader Engine comportant chacun 16 CU. Ces derniers ont évolué avec RDNA 3, puisque les Stream Processors qui les composent, permettant l’exécution de Dual Issue lorsque les conditions s’y prêtent (2 instructions extraites d’un même Wavefront ) via le doublement du nombre d’ALU FP32. Ce n’est pas le seul ajout, puisque l’on trouve également présentes des unités matricielles qu’AMD nomme ici AI Accelerators. Il s’agit d’un équivalent aux Tensors Core du caméléon. Enfin, on notera que les Ray Accelerators évoluent également avec RDNA 3 en comparaison de la précédente microarchitecture.

À l’instar d’AD106, le bus PCIe est limité à 8 lignes en Gen 4.0. Comme son concurrent, la bande passante délivrée est suffisante pour ne pas brider un GPU de ce calibre, y compris lorsqu’il fonctionne en Gen 3.0. Cela pourra toutefois avoir un impact significatif, lorsque l’accès à la mémoire centrale sera rendu indispensable, en cas de saturation de la VRAM par exemple. Une situation qui a plus de risques de se produire avec des cartes embarquant 8 Go, ce qui est bien le cas de cette RX 7600. Autres apports de RDNA 3, les moteurs d’affichage et vidéo progressent. Concernant le premier, qu’AMD nomme poétiquement Radiance Display Engine, on notera le support du Display Port 2.1 longtemps attendu (tout du moins le 2.0). Malgré tout, pour les définitions visées par une telle carte, difficile d’y voir un réel intérêt par rapport au 1.4. Plus intéressant, le moteur vidéo prend en charge l’encodage AV1, ce qui pourra intéresser certains joueurs/streamers. Voilà ce que nous pouvions dire sur ce Navi 33, il est temps de passer à la description de la carte de test page suivante.

comme toujours tres bon test

je ne vois pas comment amd aurait pi faire mieux

si on fait un die monolithe en 5 nm plus cher avec une meilleur fréquence j'ai peur que la bande limite

si on augmente le bus on concurrence le futur navi 32 en version castré

amd est un peu coincé j'ai l'impression

Enfin une carte sous les 299 €, ça c'est la vraie bonne nouvelle. La mauvaise, c'est que pour la voir à son prix réel, on risque encore d'attendre un peu de temps ... :/

Oui! Mais c'est sympa de voir qu'enfin les GPU reviennent à des prix décents. En tout ça semble bien augurer pour le rapport qualité-prix des futurs gens, et ça c'est bon!

Oui, en effet. On pourra probablement compter au temps venu, sur quelques soldes ou rabais qui la rendront encore plus sexy pour celui qui ne veut pas se ruiner en achetant la dernière gen.

Mouais. Je trouve la carte décevante, comme la 4060 Ti.

Plus de 300 balles pour ça (pour l'instant j'ai vu 320 balles pour la moins chère), ça ne les vaut pas. Les 8 Go, etc, on ne va pas refaire le débat. Franchement pour quelqu'un qui souhaiterait remplacer une carte vieillissante pour jouer en 1080p, autant prendre une RX 6600. Elle est trouvable à 200 balles et fait tourner les derniers gros jeux en 1080p/high sans soucis majeurs. Alors évidemment, elle ne va pas durer des années comme ça mais je vois mal une RX 7600 résister bcp mieux dans le temps. Autant faire le dos rond, prendre la carte la moins cher pour la garder moins et investir vraiment quand nVidia et AMD auront décidé d'enfin se sortir les doigts.

Tu sais, la RX 6600 était au même prix à son lancement. Alors attends la prochaine gen, et tu trouvera la 7600 au même prix 🙃

Oui, je sais. Mais je me base sur la situation actuelle et je me dis que si on veut jouer avec un budget limité, autant prendre la carte la moins chère en attendant que nVidia et AMD proposent des produits réellement intéressants avec une quantité de vram suffisante, etc. La prochaine gen, même si la 7600 se trouve à 200 €, si les remplaçantes sont plus généreuses en vram et avec un prix correct, la 7600 n'aura plus aucun intérêt. Et c'est bien tout le problème ici, nous sommes face à des cartes peu intéressantes pour quelqu'un qui a un GPU pas trop vieux mais qui commence à tousser sévère sur les derniers jeux, on sent bien qu'en achetant ça au prix fort, ça ne durera pas des années. Quant à ceux qui voudraient changer une 1060 par exemple, partir sur une 7600 ne semble pas être un bon choix en terme d'anticipation et de durée.

Tu peux toujours attendre un truc qui n'arrivera jamais. Pour du FHD 8 Go ça suffit et il n'y aura jamais la carte à 250€ sans limitations. Si tu veux un truc durable tu peux également te trouver une CG à 600€ qui tu vas amortir sur plusieurs années et si ton kif c'est le fhd alors elle va te tenir 15 ans.

On a déjà vu des cartes FHD à plus de 8 Go et c'est pas si vieux que ça. Quant à la question des 8 Go suffisant, le temps va vite juger ça je pense. Certains (je précise que je ne parle pas spécialement de ce site) vont ramer en retournant leurs vestes vu l'aplomb avec lequel ils ont affirmé que 8 Go c'est la panacée et que la 4060 Ti tiendra le coup longtemps. Si c'est le cas, je serai ravie de reconnaître mes torts mais je n'y crois pas du tout.

Sauf qu'on le voit dans ces tests, ces RX 7600 et RTX 4060 Ti se débrouillent en fait plutôt bien en 1440p également. Donc le débat sur la quantité de VRAM pour une carte pérenne est totalement ouvert (même si certains rédacteurs semble vouloir le clore...)

Paraît que RDNA 4 (et l'autre tambouille chez les verts) pourrait casser la baraque. Mais bon, on disait la même chose d'RDNA 3 🤣

@Titi : je ne clos pas le débat sur les 8 Go, jusqu'à présent je vois que ça limite pas, et que les jeux où ça limite sont des jeux poubelle codés avec les pieds, pas très beaux au point de se poser légitimement la question du "pourquoi plus de 8 Go de VRAM pour des torchons pareils". Apres je suis pas devin, mais pour du FHD, qui est le domaine de prédilection des cartes, ça fait le job. Si tu joues en définition supérieure, on sort du cadre d'usage défini par le constructeur, chacun prend ses responsabilités. J'entends tout hein 🙂

Il y a qq temps et ici même il y avait le débat de la rtx 3070 et ses 8 Go de Vram et bq de monde était là à dire que 8 Go c'était limitant. Je pense que c'estlimitant pour les portage qui sont trop souvent mal optimisés et également l'utilisation du DLSS ou FSR qui consomment également plus de Vram. Après faut pas vouloir mettre tout à fond lorsqu'on veut prendre une CG à moins de 500€. C'était vrai déjà avant alors c'est encore plus vrai en 2023 avec des moteurs qui consomment bq de ressources.

A ceci près que ce qui joue sur la consommation de VRAM est moins la résolution sur laquelle on joue que la résolution des textures.

Et entre FHD et QHD, on reste globalement sur un besoin de textures similaires (textures 2K : 2048x2048px) alors qu'en passant en UHD on arrive sur des textures un cran au dessus (textures 4K : 4096x4096px) qui forcément prennent beaucoup plus de place.

Et le problème des 8Go vient essentiellement d'embarquer sur la VRAM des textures inutilement lourdes (si un joueur à la possibilité de monter un curseur un cran plus loin, il le fera).

Un article très intéressant sur le sujet : Why Does 4K Gaming Require so Much VRAM? | Tom's Hardware (tomshardware.com)

Bonjour,

merci pour ces tests, mais j'ai aussi quelques remarques et suggestions.

Je ne vois pas l’intérêt de faire des comparatif "récap" des cartes entre elles (comme vous l'avez récemment fais sur uniquement quelques points).

Plusieurs soucis à mon avis (selon mes habitudes en tout cas).

Le temps gagné pourrais permettre de compléter le protocole de test pour le côté "Pro / Productif / Créatif".

En effet, les cartes graphiques ne servent pas qu'aux jeux (vous le dites vous mêmes très bien.

Mais je trouve le point 11 est "assez léger".

Par exemple, j'utilise très peu Da Vinci, et encore moins en 8k...

Faire des tests avec Da Vinci en 4k, 1080 en AV1, x265/x264 "colle" plus à la réalité.

Et moi par exemple (je ne pense pas être le seul), j'utilise beaucoup Première Pro, là aucun test...

Et en photographie, j'utilise également beaucoup Dxo qui avec DeepPrime utilise beaucoup les CG. Mon CPU (R9 3900x) met pas mal de temps pour "débruiter" les images ou la conversions RAW --> DNG ou TIFF (mais là c'est plus rapide).

Ou encore Lightroom très utiliser, et que dire de Photoshop ?

L'intégration des ces logiciels très utiles et surtout très utilisés serais un grand plus, comme je vous l'avais déjà demandé sur le précédent site.

J'espère que vous pourrez tenir compte de ces remarques.

Amicalement

Edit: autre point que je viens de voir:

Pour arrivé sur ce test, on peut aussi passer par https://hardwareand.co/actualites/breves/test-de-l-amd-radeon-rx-7600-h-co-vous-livre-son-verdict.

Là encore, c'est quoi l'intérêt ?

Qu'un autre site fasse ce genre d'intro pour mettre un lien vers un autre site OK, mais là en interne hormis complexifier le classement, je ne vois pas ce que cela apporte ?

Ou alors, site récent, besoin de contenu pour le référencement avec utilisation des méthodes style voici ou gala.

Je vois une confusion dans tes propos. Eric est celui qui fait le dossier général, mais pas du tout celui qui fait les cartes customisées et le recap que tu décris. C'est moi qui traite ces deux parties qui ne s'entrechoquent pas. Que j'arrête de faire ces articles ne va pas libérer plus de temps à Eric pour accéder à ta requête puisque c'est pas lui qui traite ça. Le recap et les custom, c'est indiqué dans le protocole, c'est pas pour comparer les perfs en 3D des customs ayant le même GPU (on met 2 jeux Eric 20 !), c'est avant tout pour voir comment choisir la carte en fonction des seuls éléments qui restent finalement pour les départager : bruit, température et conso. Par contre pour enrichir le dossier principal qui est super violent à faire en y mettant une telle qualité et fiabilité (une centaine d'heures mini), il faut attendre qu'Eric se manifeste en ce samedi ensoleillé 😊