Quoi qu’on en pense ?

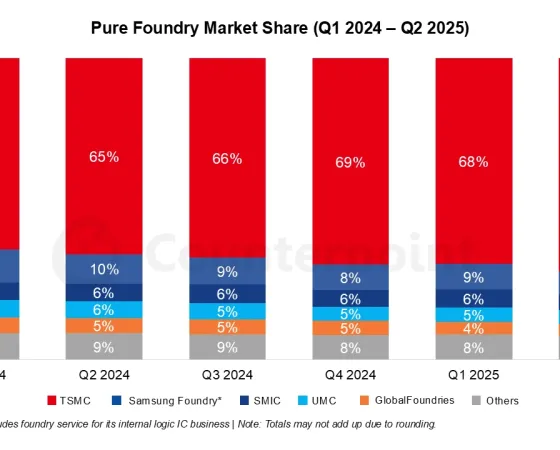

Arrivés au terme de cette sympathique balade processoresque, que peut-on en conclure ? D’une part, qu’il vaut mieux savoir sa patience garder et sa bouche point trop n’ouvrir puisqu’aucun chiffre de performance en condition réel n’a été communiqué. Entre le N3B tout neuf et l’écosystème logiciel encore incomplet au vu de la disponibilité encore lointaine des puces, difficile cependant d’en vouloir au géant bleu. Néanmoins, en se basant sur ses caractéristiques papier, Lunar Lake a tout ce qu’il lui faut pour taper fort là où la firme le souhaite : l’autonomie. Entre le procédé de gravure plus avancé que le concurrent AMD (qui fait usage du 4 nm) et la possibilité de désactiver complètement les P-Core pour gagner en consommation, Intel met un pied dans le territoire d’Arm — comme par hasard, pile au moment ou Qualcomm attaque le segment x86 des PC portables.

Au niveau des performances, les E-Core devraient faire le job sur les tâches légères dominées par les branchements et/ou le calcul entier, mais les P-Core se retrouveront incontournables dès qu’une application un tant soit peu demandeuse sera lancée. Rajoutez l’absence d’Hyper-Threading et d’AVX-512, et la démarcation avec le concurrent semble toute tracée : pour de l’applicatif, AMD propose sur le papier une architecture plus adaptée, mais pour un usage léger généraliste, les bleus ont l’avantage technologique. Tout cela reste évidemment à vérifier sur le banc de test, d’autant plus qu’en matière d’ordinateur portable basse consommation, l’intégration par l’OEM joue également un rôle de taille dans l’expérience utilisateur finale.

Lunar Lake : on ne vous promet pas la lune, on la décroche pour votre laptop !

Et l’IA dans tout ça ? Pour le moment, son principal souci réside dans le logiciel : Copilot+ PC, l’intégration Windowsienne de la chose, ne nous permet pas à l’heure actuelle de nous rendre compte de l’écart de performances entre processeurs. Ou, en tout cas, pas dans quelques minutes de test : quelles que soient les démonstrations mises en place par les divers fabricants auxquelles nous avons pu assister, nous n’avons pas observé de delta significatif dans les performances des concurrents. La question de l’utilité peut également se poser, bien que le sous-titrage/traduction automatique (ou l’upscaling par IA) peut se révéler pratique dans certaines situations : la réponse d’ici quelques mois, une fois les appareils sur les étals !

Tout cela est très intéressant

Ça peut paraître bizarre qu intel produit un cpu pas avec ça gravure

Le n3b est le die le plus efficient et le plus dense actuellement en plus intel est mauvais en transistors gpu ( haute densité ) voulant faire ultra compact et efficient c'est une bonne idée

A l'inverse le die soc en n6 me surprends

Pas besoin du n3b pour ce die il est ultra cher pour un gain très réduit ( les transistors hors ceux pour la logique progresse très peu voir quasiment pas vs le n5 )

Le n6 est "vieux" maintenant alors oui il est moins cher mais j'aurais plus vu n5 ou un de ses dérivé piur gagner en taille et en consommation

Bon après lecture approfondie j'ai l'impression que intel est revenue en arrière sur un point

Meteor lake avait explosé en mcm

La on revient comme avant Meteor lake le compute die intègre se qu'avait le die gen 13/14 et le second due c'est le chipset qui était côté

C'est la même chose mais emballé en 2.5d avec une nouvelle gravure

Le SMT s’avère surtout être une faille de sécurité perpétuelle, entre les fix et les patchs pas sur que ce soit vraiment une perte de performances de le virer 😅

Intel avec son lunar lake, qualcomm avec son xlite, amd machin truc et nvidia cpu machin truc... windows qui va devoir jongler avec les 4 ... Et tous les logiciels qui ne sont pas en natif et sans oublier tous les dell, asus et autre qui vont faire des variantes matérielles de leur ordinateur....

Quelle horreur la complexité des variantes et la fragmentation infinie que ça va engendrer et les bugs que Windows ne sait pas gérer...

Bonne chance pour que ça fonctionne sans accroche.... Faudrait songer à utiliser apple

Passez chez Apple, ils ont peu de variantes matérielle, ils créent leur propre puce, Ils font leur propre OS, tous les logicielles suivent Apple.

Amd et intel c'est du x86 donc pas de soucis et arm il y a emulateur apprement aussi performant que rosetta 2

Donc ça devrait aller

Apple ces gens qui décident arbitrairement quand ton ordinateur est obsolète en arrêtant de le mettre a jour, non merci 😬

Article beaucoup trop "technique" pour moi et mes maigres connaissances néanmoins je suis sûr que cela a fait plaisir à d'autres lecteurs qui ont du apprécier votre expertise et c'est bien là l'essentiel.

J'ai eu l'impression de relire certains articles de HFR !

C'était le bon temps hfr

J'avoue c'est complexe mais c'est aussi complet du coup

Après il y a les slides et les graphiques d intel plus simple à comprendre

Je ne cache pas que HFR ça a été notre référence et que c'est le type de contenu que nous visons. Le souci c'est qu'il faut vulgariser 20 ans de progrès hardware avant de lister les changements de la nouvelle génération ; dur dur pour quelqu'un qui débarque ! Cependant, avec un format récurrent expliquant certains mécanismes CPU peut etre une bonne idée pour pouvoir les référencer à divers endroits du dossier :-)

Moi jai compris les autres ..... 🤣

Super analyse très détaillée! En effet ça semble prometteur, faudra voir la réalité dans les produits.

La suppression de l'HT va forcément avoir un coût sur certains workloads, notamment ceux orientés I/O (stockage ou réseau) où il est possible d'avoir les drivers bindés sur les threads pairs et le userland sur les thread impairs, partageant ainsi le cache L2 avec une ultra-faible latence. Intel avait déjà fait ça sur les core2 en disant "meuh non de toute façon ça servait à rien" puis ils l'avaient réactivé sur les Core en disant "regardez ce qu'on vous a ajouté, c'est bien non?".

Pour le coup, la suppression de l'AVX512 est une ânerie. Ils ont investi plein d'extensions là-dedans, encouragé les clients à s'en servir, et au moment où leur concurrent préféré l'adopte de manière assez fûtée, ils baissent les bras. Pour moi ils auraient dû faire comme leur concurrent, et splitter les instructions 512 sur 2 ports 256 et n'en faire qu'une par cycle, et éviter ainsi d'affecter la consommation et la fréquence de fonctionnement. Ca permettrait au moins de profiter de certaines fonctionnalités utiles comme l'IFMA, très utile pour la crypto asymétrique.

A suivre...

Avx 512 va revenir avec avx 10

L'avx-512 reviendra pour les pro, mais ca fait depuis Alder Lake que ça n'est plus sur les proco grand public car les E-Core sont anémiques en calcul flottant (cest ~ du SSE derrière) et l'OS ne supporte pas des extensions différentes sur un même cpu

Pourquoi donc? Et le Thread Director, il n'est pas fait pour ça?

Non, Thread Director apporte un conseil sur un coeurs possiblement optimal pour placer. Un conseil n'est pas une contrainte !

Il faudrait que tous les processus déclarent en avance si ils utilisent de l'AVX512, et ça cassera la rétrocompatibilité (pour le moment c'est "tu lis un bit dans un registre interne, et si c'est une certaine valeur, alors tu as l'AVX-512", or si l'OS dit que tu est compatible, et que tu te fais scheduler sur un coeur dépourvu... boum). En plus, l'AVX-512 est très peu utilisé par le grand public et prend quand même un peu de place : sur un SoC basse conso, l'avoir est moins d'être une nécessité