Hier, AMD a tenu l’édition 2024 de sa conférence annuelle "Advance AI". L’entreprise a parlé de beaucoup de choses et notamment de ses accélérateurs IA, le nerf de la guerre autour de l’intelligence artificielle et une source fantastique de revenu jusqu’à présent pour les vendeurs. Certes, pour certains, assurément plus que pour d’autres. Malgré sa position, ce que fait AMD dans le domaine est tout de même important, la marque étant pour l’instant avec ses MI300 la seule vraie concurrente en lisse contre NVIDIA, qui domine outrageusement le segment à ce jour. Quant à Intel, sa contribution a pour l’instant été guère plus qu’anecdotique, malgré les différentes tentatives.

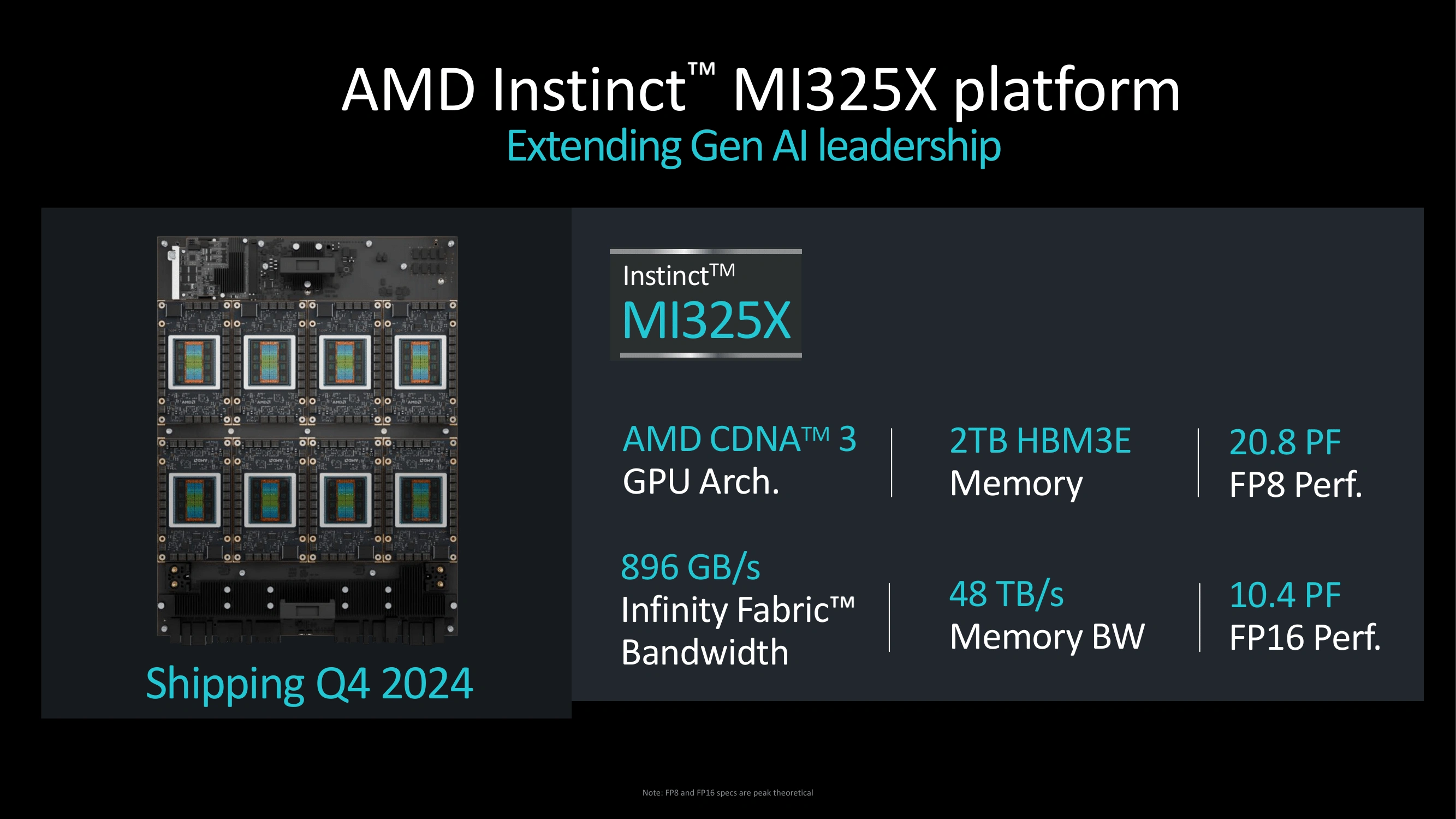

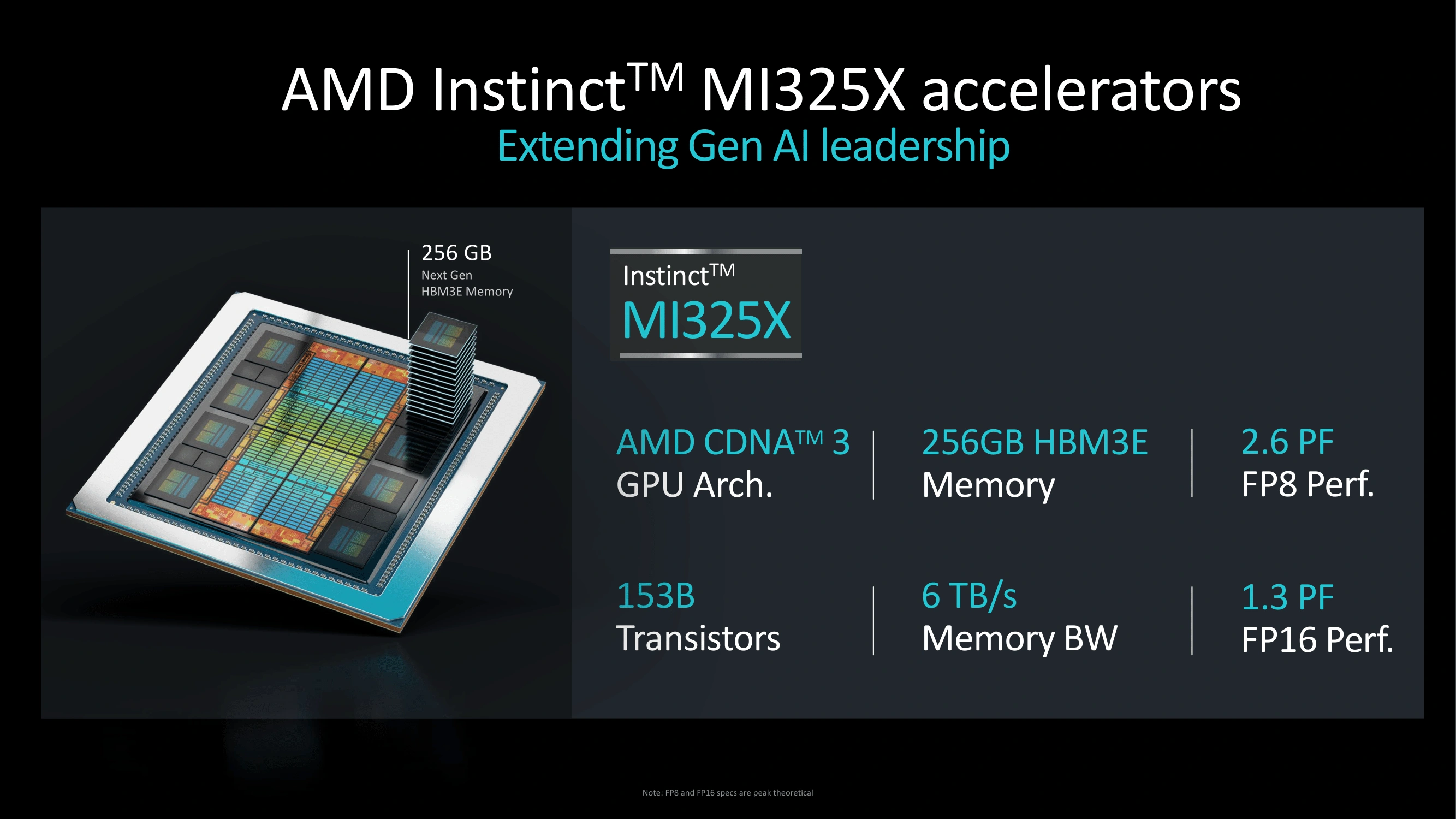

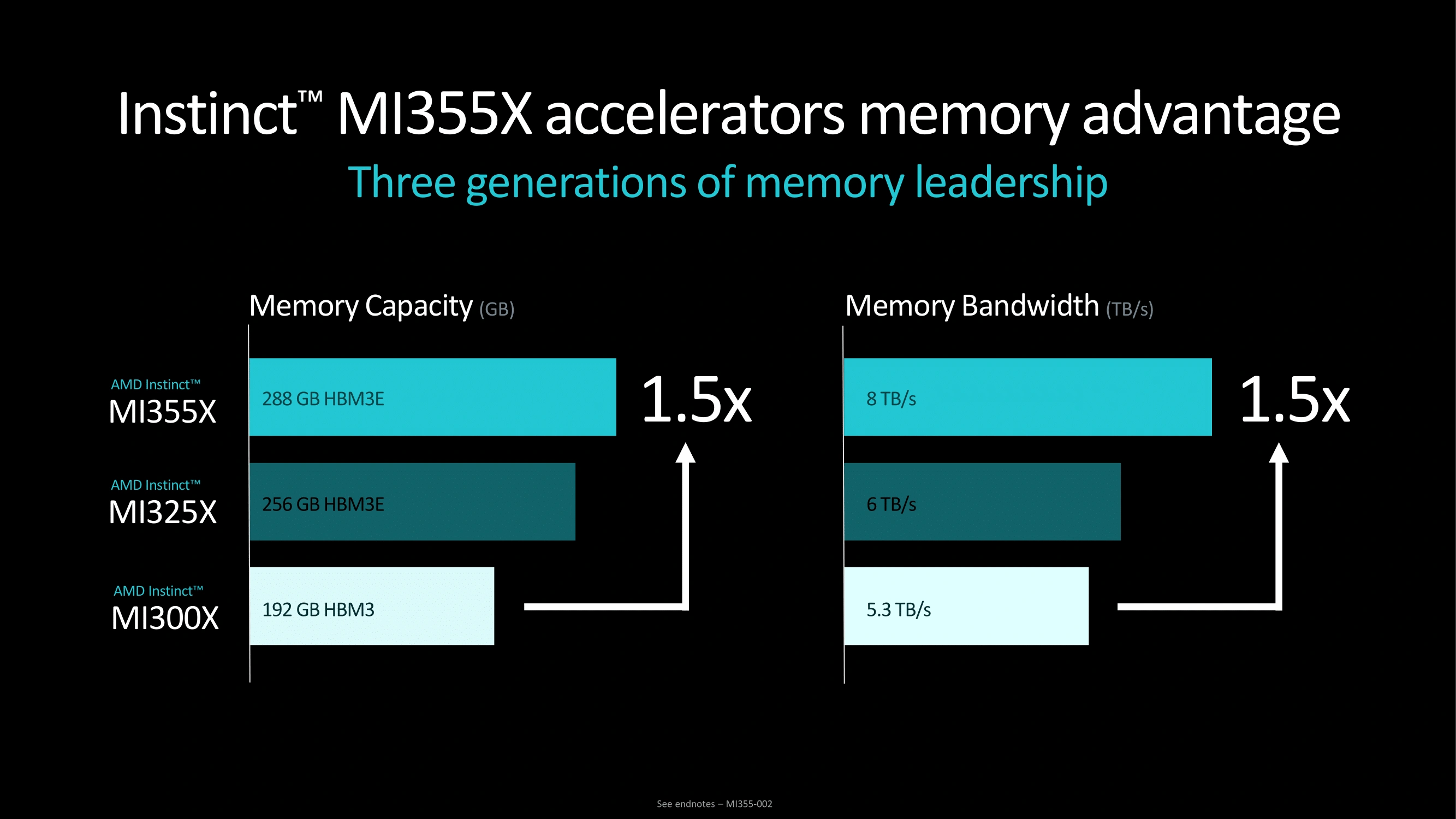

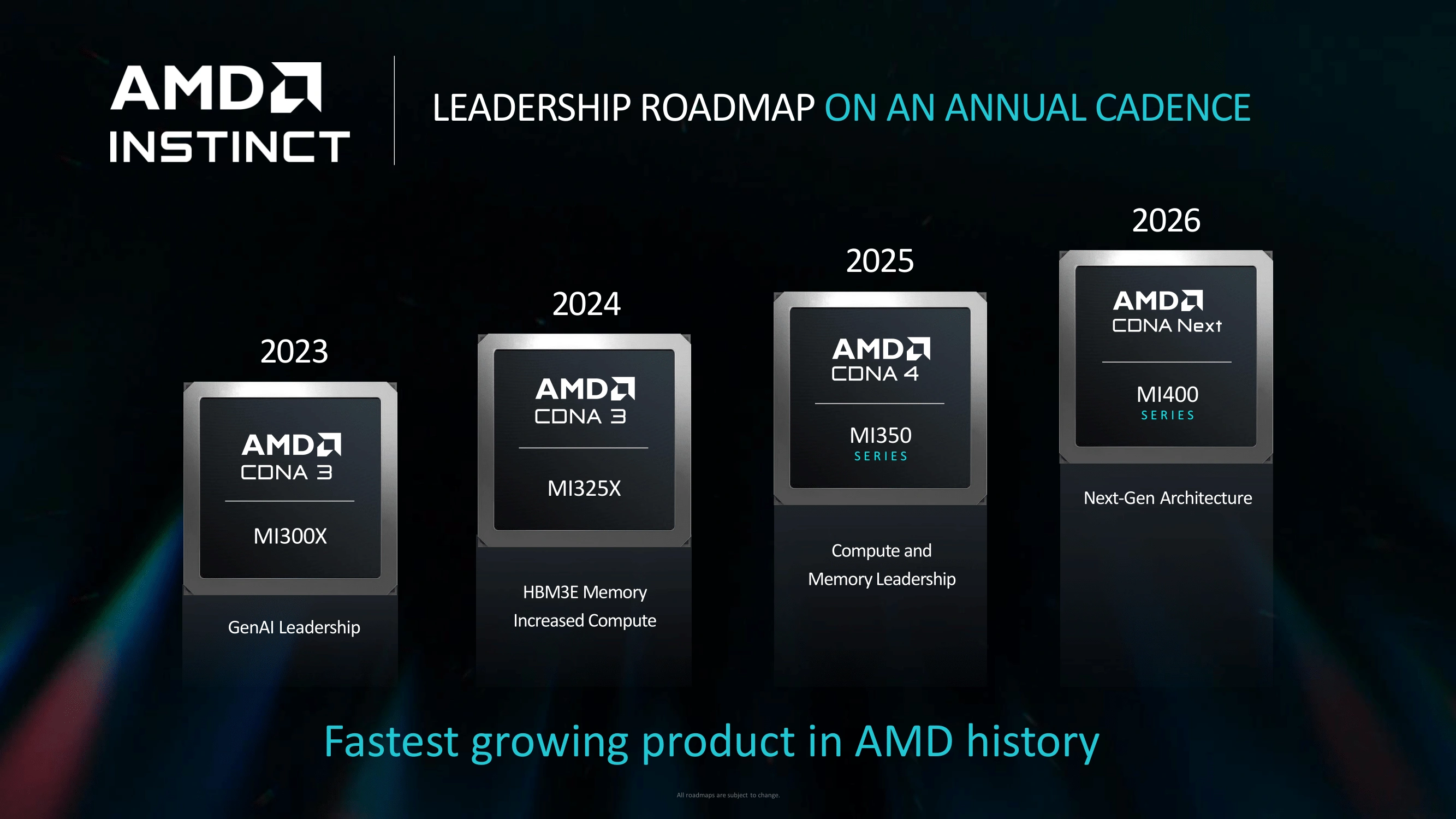

Vous vous souvenez peut-être encore qu’AMD avait brièvement mentionné l’accélérateur Instinct MI325X lors du Computex 2024. Eh bien, lors de la conférence, AMD a (re)confirmé que ce modèle, une évolution du MI300X lancé en décembre 2023, est désormais entré en production et sera disponible durant le premier trimestre de 2025. Ceci équivaut à un petit retard, puisque l’accélérateur étant initialement programmé pour être disponible lors de Q4 2024. Toutefois, un ajustement a été effectué avec le MI325X. En effet, annoncé au départ avec 288 Go de HBM3E, il sera finalement proposé avec "seulement" 256 Go. La bande passante sera inchangée. Ce qui aurait dû être une augmentation de 50 % de la quantité de mémoire par rapport au MI300X n’en sera plus qu’une de 33 %. C’est par ailleurs la seule évolution majeure entre les deux modèles, le reste des spécifications de la puce toujours basée sur CDNA 3 est largement identique, mais avec un TDP pouvant désormais aller jusqu’à 1000 W.

AMD a soigneusement évité d’expliquer pourquoi et comment, et s’est contentée de dire que c’est mieux ainsi. Le plus probable est que le problème se situait du côté des nouvelles puces HBM3E de 36 Go, qui n’étaient peut-être finalement pas encore disponibles, ou n’arrivaient pas encore à tenir les spécifications souhaitées en quantité suffisante. Vous pensez bien qu’AMD n’a pas dû être ravie d’effectuer ce changement, alors que Lisa Su en personne avait présenté le MI325X avec ses 288 Go de HBM3E au Computex, il y a quelques mois à peine. Rappelons que NVIDIA aussi a connu quelques déboires avec la mémoire HBM par le passé ayant obligé à des ajustements.

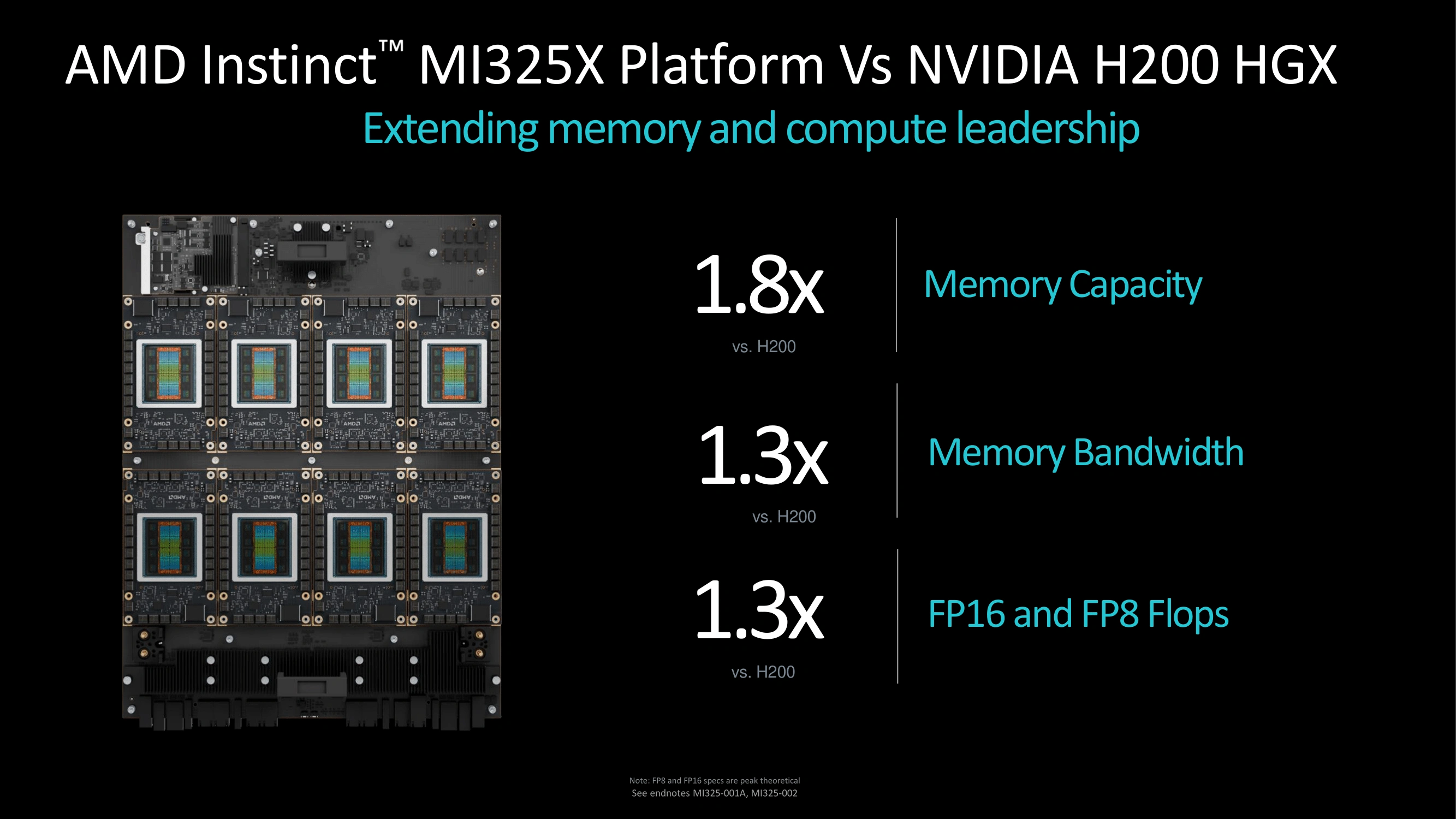

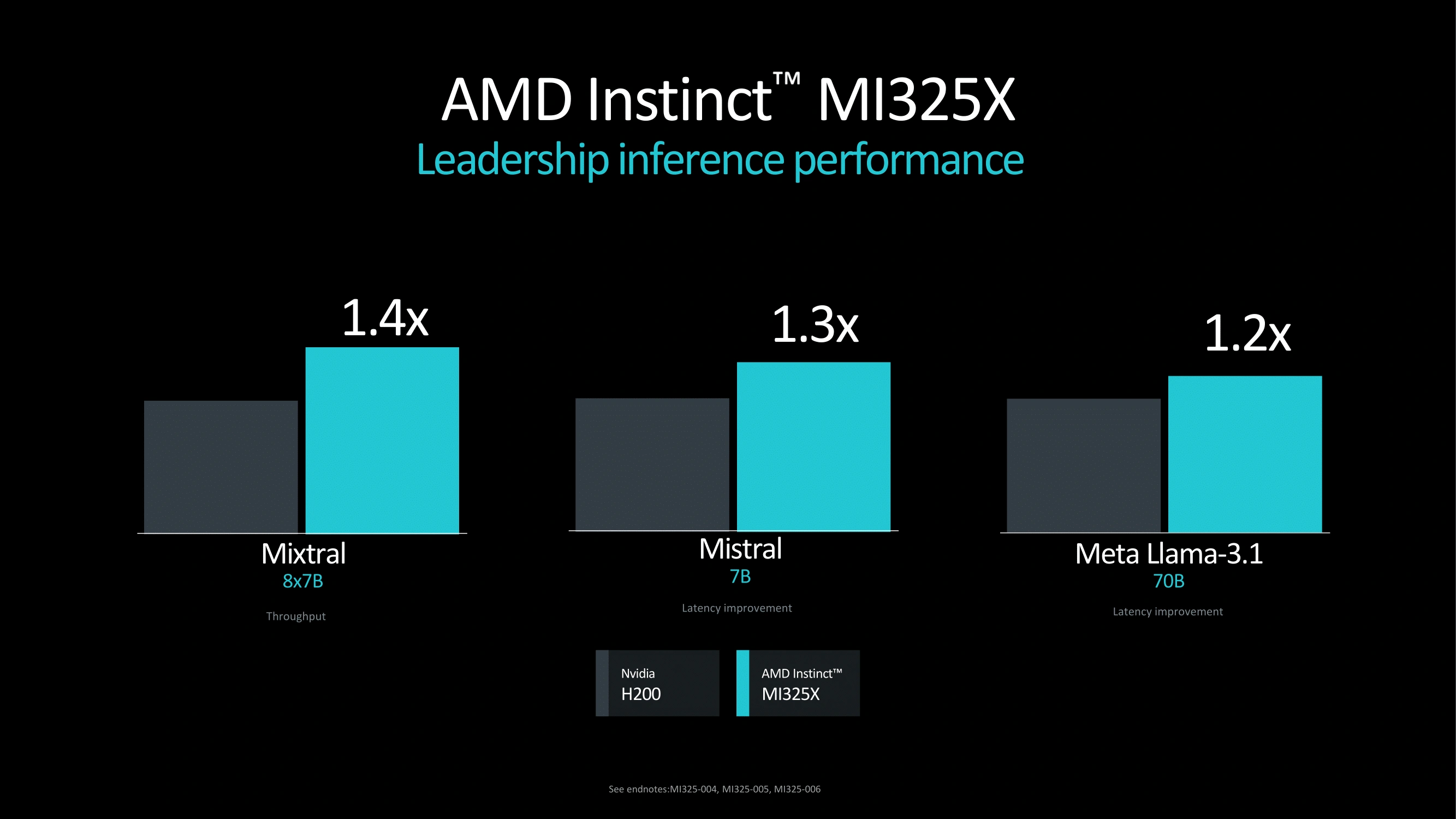

Quoi qu’il en soit, le MI325X ne sera pas de trop pour lutter contre NVIDIA et faire barrage autant que possible. Mais les comparaisons indépendantes se doivent encore d’être effectuées contre les concurrents directs H100 et H200 de NVIDIA. AMD n’a pas souhaité discuter en détail la tarification de ses accélérateurs, mais simplement dit que leur objectif est de fournir un avantage en termes de "cout total de possession". Autrement dit, soit offrir de meilleures performances pour le même prix, soit offrir un prix plus bas pour les mêmes performances, soit quelque chose entre les deux. En tout cas, l’entreprise a affirmé prendre des décisions responsables en ce qui concerne les prix...

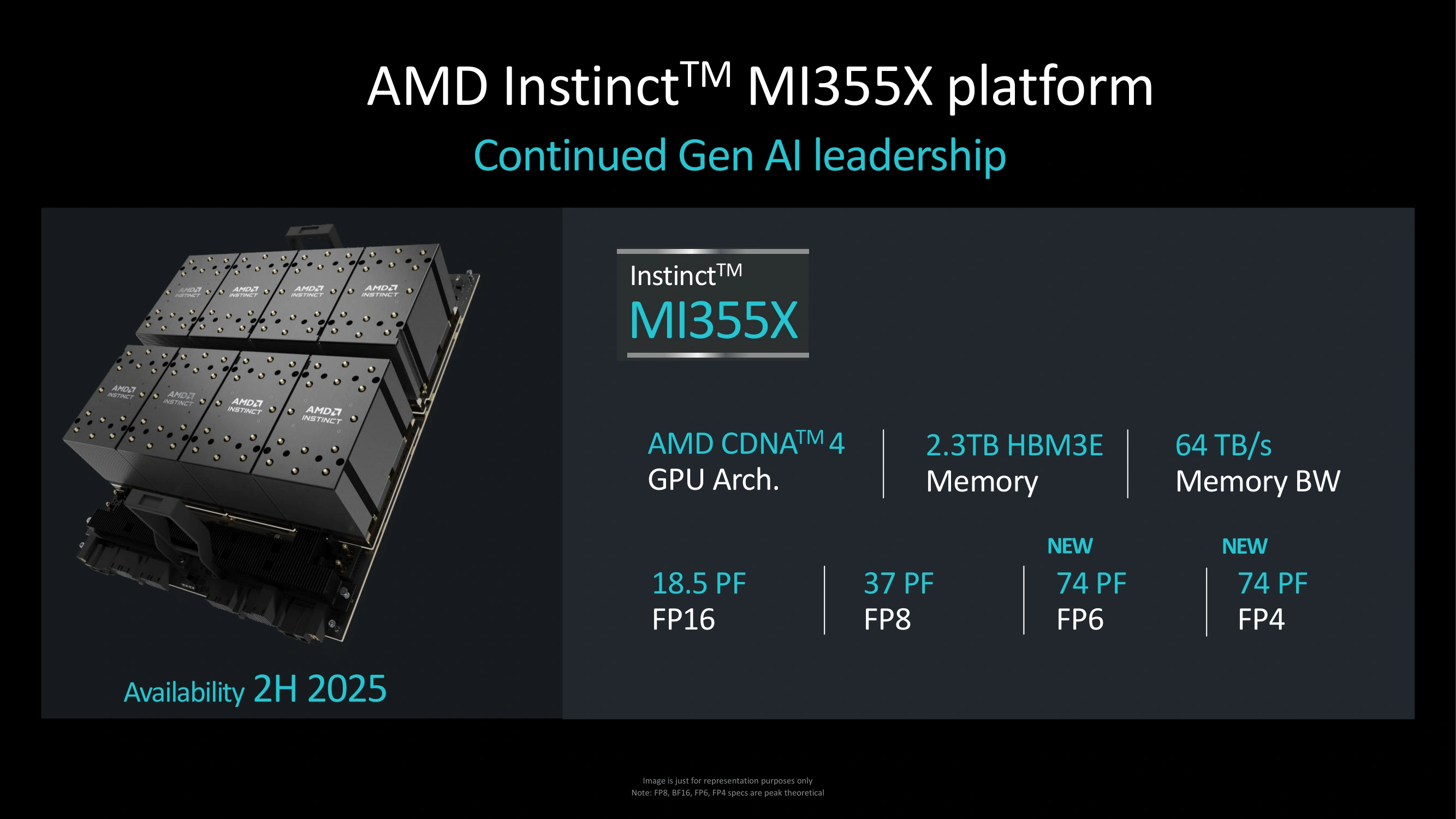

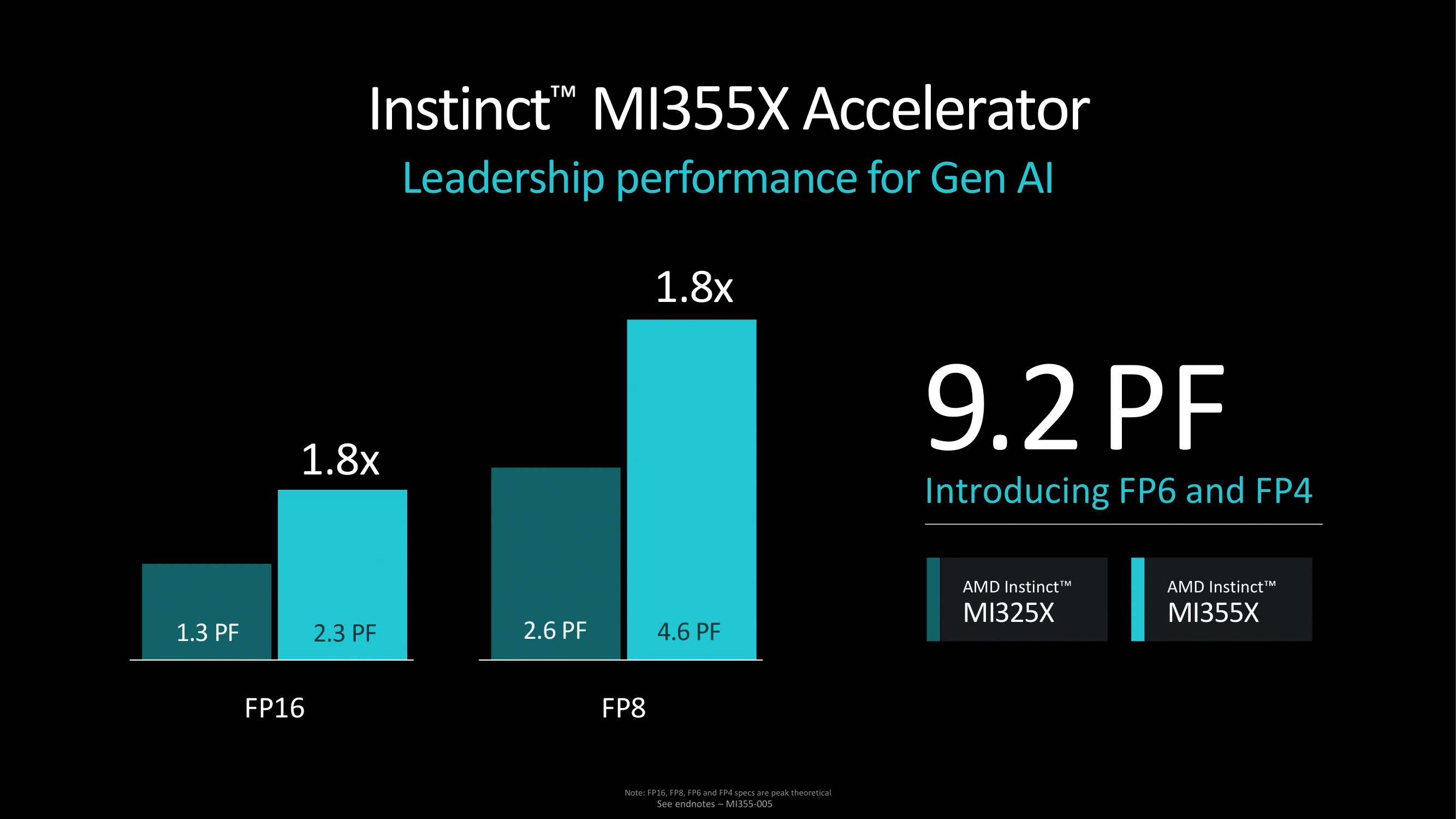

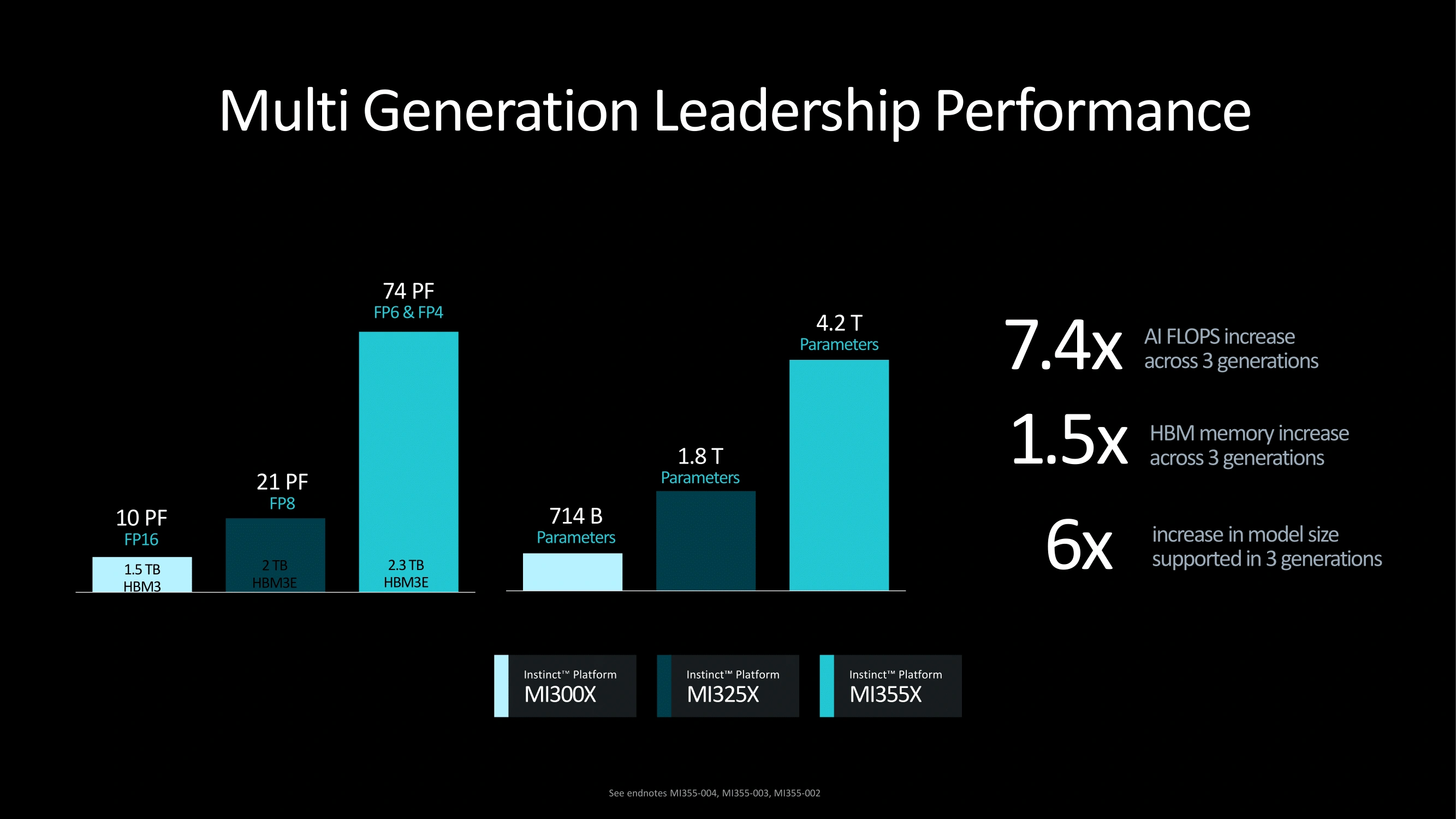

Logiquement, le B200 Blackwell de NVIDIA devrait être hors d’atteinte de l’accélérateur MI325X. Mais pas de panique, AMD va jouer une nouvelle carte durant la seconde moitié de 2025 : l’Instinct MI355X, dans le cadre d’une nouvelle série MI350 ! Celle-ci sera cette fois-ci animée par CDNA 4, selon AMD, une "refonte complète" de son architecture CDNA. Cependant, la conception de base devrait être assez similaire à celle de CDNA 3. Hélas, ce qu’une "preview", l’entreprise ne partage pas encore tous les détails de son prochain engin. Par conséquent, certaines des spécifications mentionnées ici peuvent changer au fil des prochains mois. Voici ce qui en a été dit pour l’instant :

- Nouvelle architecture CDNA 4

- Puce produite avec le procédé N3 de TSMC

- 10 "compute elements" par GPU (soit 2 de plus que le MI325X ?)

- Jusqu’à 288 Go de HBM3E

- Support des types de données FP4 et FP6

- Lancement mi-2025

La puissance brute connaitrait une amélioration de 77 % par rapport à la génération précédente/actuelle MI300/MI325X. Mais surtout, AMD attribue déjà jusqu’à 9,2 petaFLOPS en calculs FP4 à son MI355X, un chiffre qui le placerait à niveau du B200 de NVIDIA et ses 9 petaFLOPS, et pas très loin des 10 petaFLOPS en FP4 du GB200. Ajoutez à ceci qu’avec 288 Go de mémoire, AMD en proposerait 50 % de plus que ne le fait NVIDIA actuellement avec Blackwell, certes, avec une bande passante identique de 8 To/s par GPU. Bien entendu, rien n’empêcherait NVIDIA de faire un refresh avec plus de mémoire, comme l’entreprise l’avait déjà fait par le passé. Bref, en se basant sur ces chiffres seuls, un MI355X aurait potentiellement une puissance de calcul équivalente au B200.

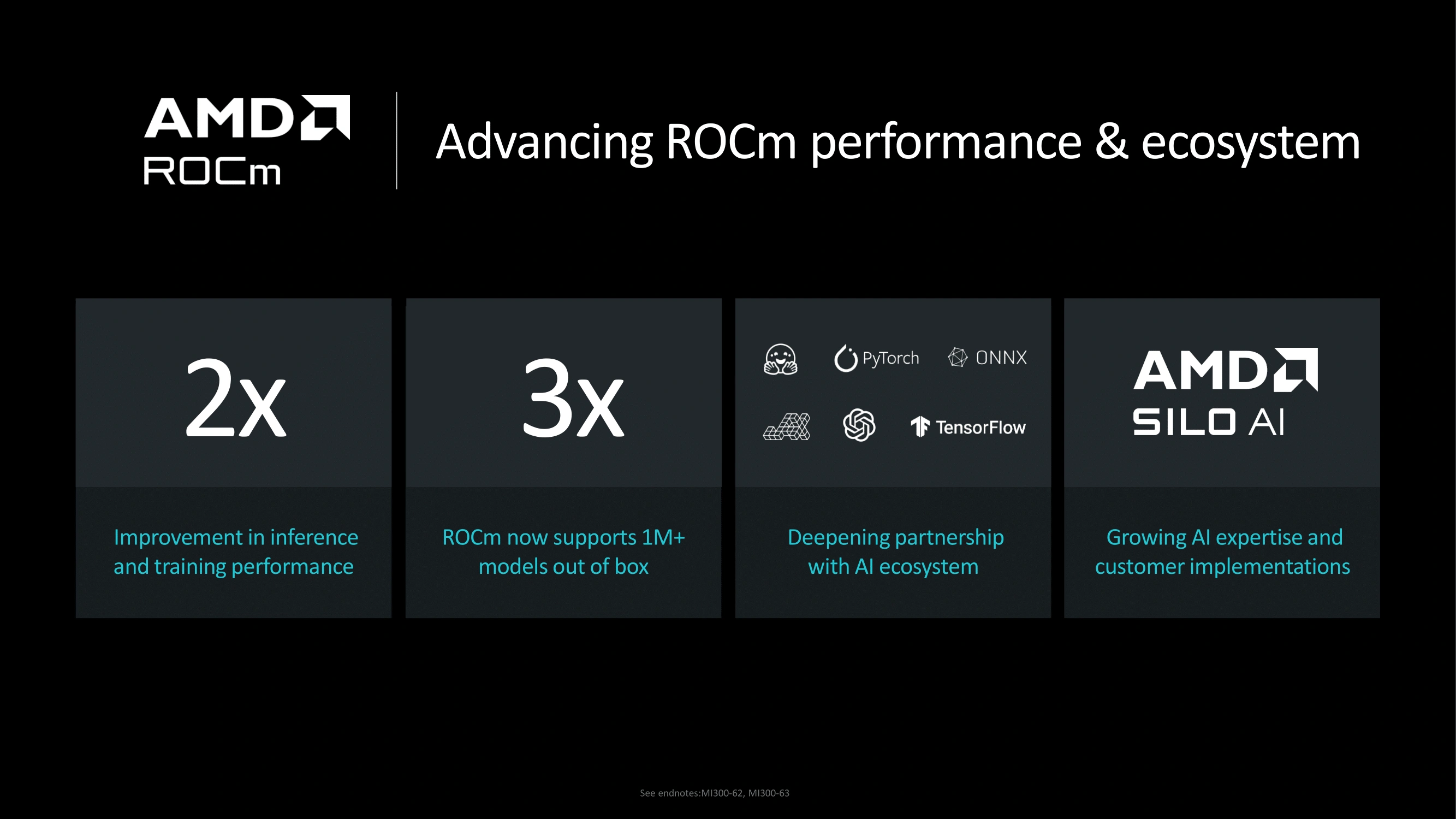

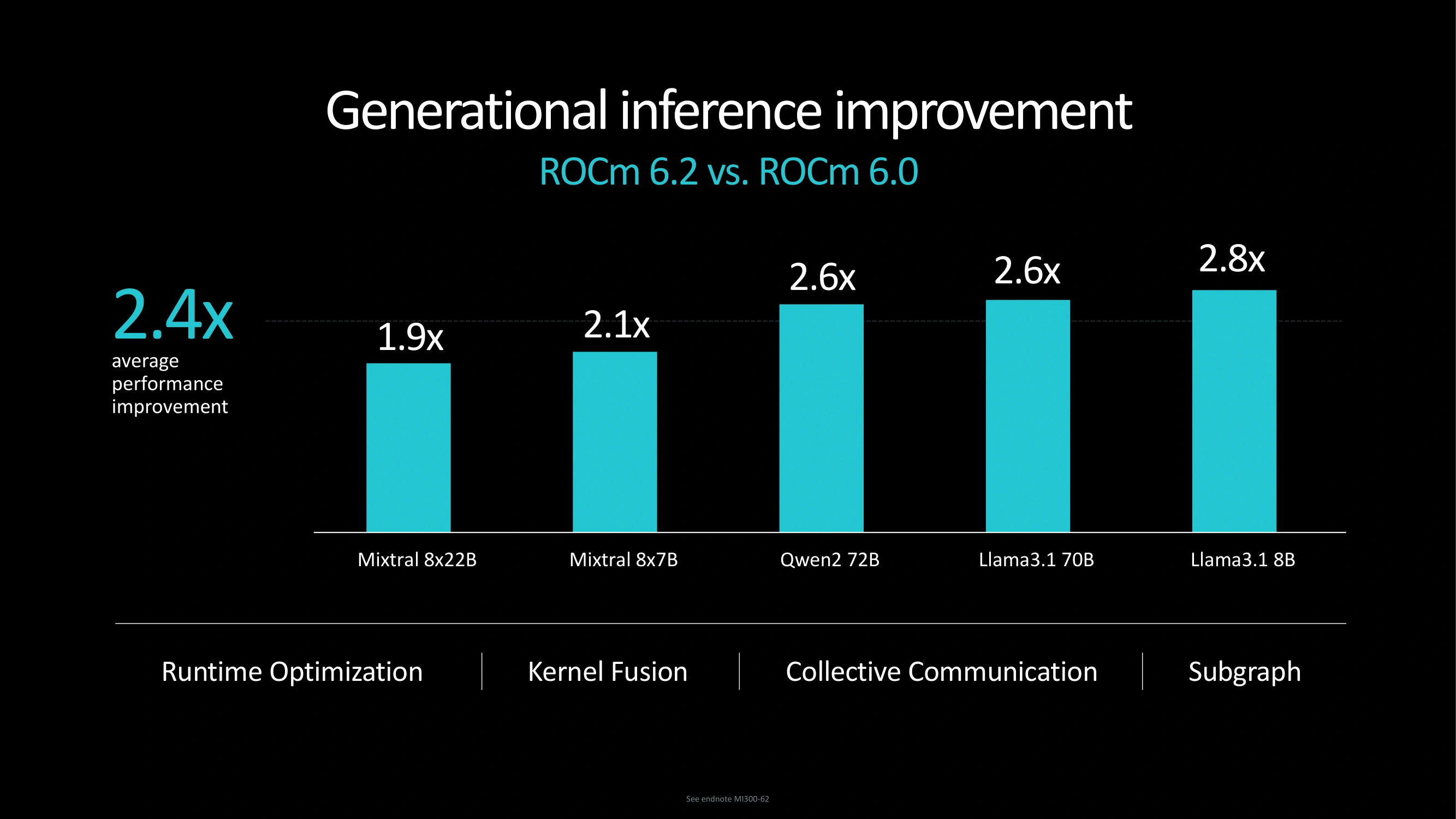

Évidemment, il y a beaucoup d’autres facteurs à prendre en compte et affectant les prestations d’un GPU dans ce domaine, autant au niveau matériel que logiciel. Justement, lors de la conférence, Lisa Su a clairement indiqué que son entreprise est consciente de la nécessité d’améliorer la partie logicielle, le véritable talon d’Achille de son offre. En effet, bien qu’étant une alternative intéressante et prometteuse, notamment pour sa nature open-source, son framework ROCm a encore du chemin à parcourir avant d’être aussi optimisé et mature que l’écosystème CUDA de NVIDIA. Cependant, les performances ont déjà beaucoup évolué en l’espace de peu de temps au gré des nouvelles versions. Et sinon, Silo AI et ZT Systems à la rescousse ?

Dernières petites informations pour finir. AMD n’a pas été claire quant à l’éventuel successeur de l’Instinct MI300A, la version APU du MI300X dans laquelle des cores GPU CDNA 3 ont laissé leur place à 24 cores CPU Zen 4. L’entreprise a bien fait comprendre que sa priorité en ce moment est les accélérateurs de série "X". Reste à savoir si le concept sera vraiment abandonné par AMD. Enfin, après CDNA 3, viendra CDNA 4 au travers d’une nouvelle série MI400, et c’est pour 2026.

on sait pas si mi355x les interposé actif changent aussi ou s'ils réutilisent ceux du mi300

apriori pas de remplaçant du mi300a amd n'a pas trouvé de débouché c'est dommage j'aime le concept

Je me permet de signaler que Blackwell Ultra débarquera aussi à la mi-2025 avec 288 gigots d’agneau bien tendre et des performances revues à la hausse j’imagine. C’est dans la roadmap d’nVidia ainsi que Rubin pour fin 2025.